Cursor Automationsの始め方と運用設計

Cursor Automationsの始め方と運用設計

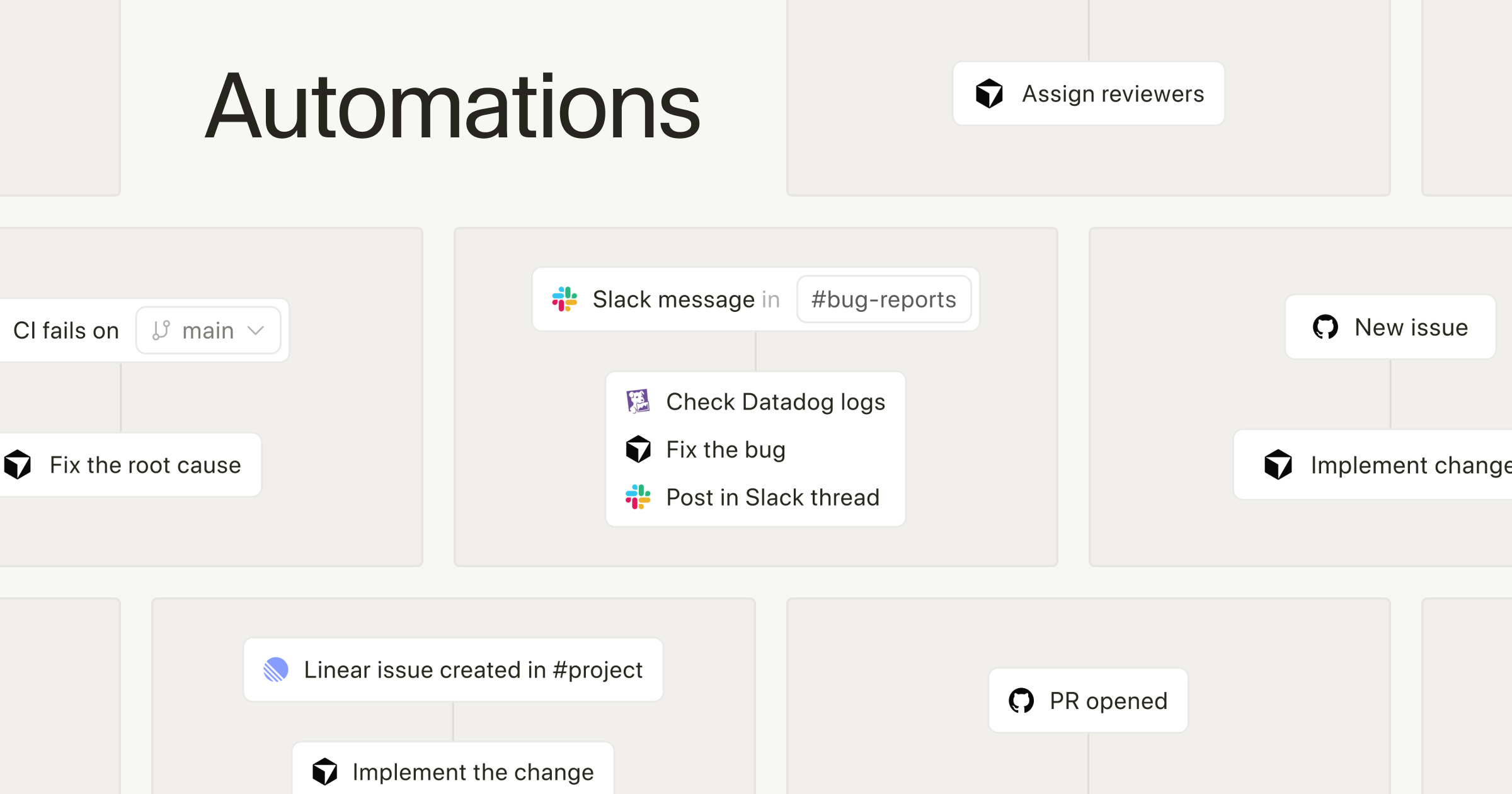

Cursor Automationsは、SlackやGitHubなどのイベント、あるいはスケジュールを起点にCloud Agentsを自動実行する機能です。

Cursor Automationsは、SlackやGitHubなどのイベント、あるいはスケジュールを起点にCloud Agentsを自動実行する機能です。

都度指示して動かす手動AgentやComposerとは役割が違い、定期チェックや夜間処理、PRレビューのような「待たせたくない作業」を自動運転に載せるための土台になります。

この記事では、Slack、Linear、GitHub、PagerDuty、Webhook を入口にして、テンプレートから最初の 1 本を安全に作り、検証する流れを整理します。

夜間に走らせた調査結果が朝イチで Slack に並ぶだけでも、手作業の待ち時間が目に見えて減ることがあります。

まずは小さく始めて失敗を見える化し、レビュー承認をゲートに入れる設計が現実的だと感じています。

そのうえで、MCPで外部ツールに読み書きできる価値と、権限過多や監査不足のリスクを切り分け、最小権限と人間レビューを前提にした運用設計まで踏み込みます。

Cursor Automations公式ブログとAutomations | Cursor Docsで定義を確認します。

2026-03-17時点の情報をもとに、PoCから上限設定、本番展開へ広げる判断基準とチェックポイントを具体化します。

Cursor Automationsとは何か

公式定義とCloud Agentsの位置づけ

Cursorの公式な説明を要約すると、Automationsはスケジュールまたは外部イベントをきっかけにCloud Agentsを自動実行する仕組みです。

定時実行のバッチに近い使い方もできますし、PR作成、Issue更新、障害通知のような出来事に反応して即座に走らせることもできます。

Automationsは人が都度起動する。

ここで中核になるのがCloud Agentsです。

処理はローカルPCではなくクラウドのサンドボックス内で実行されるため、開発者が席を外していてもジョブを回せます。

この前提があるので、夜間の定期チェックやPR直後の一次レビュー、障害通知を受けた直後の調査開始といった「人の手が空くまで待たせたくない作業」を自動化の対象に載せられます。

公開日は2026年3月5日で、同日のリリースが確認できます。

確認日は2026年3月17日です。

実際にこの種の処理を手動起動からイベント駆動へ切り替えると、PR作成直後の人手レビュー待ちが目に見えて減りました。

レビュー担当者が最初に見る前に、形式的な確認や一次的な指摘が先回りで並ぶので、チームとしては「AIが先に見ておく列」が1本増えた感覚に近いです。

Build agents that run automatically · Cursor

Cursor now supports automations that run based on triggers and instructions you define.

cursor.comトリガー種別とクラウド実行の仕組み

トリガーとして公式に挙げられている代表例は、SlackLinearGitHubPagerDutyWebhookです。

示されており、単なる構想ではなく公開時点の機能案内として扱えます。

たとえばGitHubならPRやリポジトリ上のイベント、Slackならチャンネル上の投稿や通知フロー、PagerDutyならインシデント発火、Webhookなら自社システムやSaaSからの任意イベント連携という形で入口を作れます。

仕組みとしては、外部サービスから来たイベント、またはあらかじめ設定したスケジュールを受けて、Cloud Agentsがクラウドサンドボックスでジョブを実行します。

ここでのポイントは、実行環境が「人がその場でIDEを開いていること」を前提にしていないことです。

イベントを受け取った時点で処理が走り、レビューコメント、調査結果、要約、分類、通知といった成果物を返す流れになります。

Cursor社内で1時間あたり数百件規模のautomationsが動いていると報じられています。

単発デモではなく常用ワークロードをさばく位置づけだとわかります。

仕組みとしては、外部サービスから来たイベント、またはあらかじめ設定したスケジュールを受けて、Cloud Agents がクラウドサンドボックスでジョブを実行します。

UI の表記は変わることがあるため、設定手順を進める際は Cursor Docs の「Cloud Agents > Automations」セクションと Changelog(記事冒頭で参照している公式リンク)を併せて確認し、該当するメニュー(例: Settings > Automations、Create Automation)を基準に画面で確認してください。

手動Agent/Composerとの違い

Automationsを理解する近道は、手動で起動するAgentやComposerと並べて見ることです。

手動系は「今この場で対話しながら進める」道具で、Automationsは「条件が満たされたら裏で回り続ける」道具です。

前者は実装相談や局所的な修正、後者は監視・一次判定・定型処理に向きます。

| 項目 | 手動Agent | Cursor Automations |

|---|---|---|

| 起動方法 | 人が都度指示 | schedule / eventで自動起動 |

| 向く用途 | 単発実装、対話的修正 | PRレビュー、定期チェック、夜間処理 |

| 実行の前提 | 人がその場で操作する | イベント発生時に継続的に動く |

| 強み | その場の文脈で細かく軌道修正できる | 監視漏れを減らし、待ち時間の前に処理を差し込める |

| 主な論点 | 指示の精度 | トリガー条件、通知先、レビュー地点 |

Composerとの違いも同じ軸で捉えられます。

Composerは実装中の文脈を保ちながら一連の変更を進める対話型の作業台で、開発者がハンドルを握ったまま使う場面に合います。

対してAutomationsは、たとえばGitHubでPRが開いた瞬間にレビュー観点を走らせる、毎朝決まった時刻に差分サマリを作る、障害通知を受けたら調査テンプレートを始動するといった、常時監視と自動起動が前提の設計です。

人が毎回「実行」ボタンを押すフローを残すと、忙しいときほど抜け漏れが出ますが、イベントに結びつけると作業が列に並ぶ前に一次処理が終わりやすくなります。

BugbotとAutomationsの関係

Bugbotは、Automationsと切り離された別物というより、Automationsの先行例あるいは原型として見ると理解しやすい存在です。

公式ブログでも、PRの作成や更新に応じて自動で動く仕組みとして紹介されており、現在のAutomationsが目指す方向性を先にプロダクト化した例として位置づけられています。

象徴的なのはトリガーの頻度です。

BugbotはPR作成・更新のたびに発火します。

ここから見えてくるのは、Automationsが単なる「便利機能」ではなく、レビュー、セキュリティ確認、障害対応のような反復作業を継続的に受け持つ運用レイヤーだということです。

外部報道では社内全体で1時間あたり数百件規模のAutomations実行にも触れられており、Bugbotが点のユースケース、Automationsがそれを面に広げる基盤と考えると整理できます。

この流れを踏まえると、Bugbotは「PRイベントで自動で走るAIレビュー」の実証済みパターンであり、Automationsはその考え方をSlackLinearPagerDutyWebhookまで広げた仕組みです。

PRレビューだけでなく、障害初動やチケット整理まで同じ発想でつなげられるので、Cursorの中では個別機能の追加ではなく、AIエージェントを常時運用するための共通レイヤーが前面に出てきたと捉えるのが実態に近いです。

始める前の前提条件と必要な構成要素

アカウントと権限の前提条件

導入前にそろえるものは大きく3つあります。

まずはCursorの利用アカウント、次に自動化対象となるリポジトリへの適切な権限、最後に連携先サービス(Slack、Linear、PagerDuty、GitHub など)のワークスペース権限です。

Automations はクラウド上の Cloud Agents を使って実行されるため、誰がどの範囲を読めて書けるかを事前に決めておくと運用が安定します。

リポジトリと対象範囲の設計

次に決めるべきなのは、どのリポジトリの、どの作業を、自動化の対象にするかです。

Automations は便利ですが、対象範囲が広すぎると通知も実行も増え、かえって人の確認負荷が上がります。

最初から全社共通のモノリポ全域を監視するより、1つのサービス、1つのチーム、1つのイベントに絞ったほうが結果を見比べやすくなります。

具体的には、監視対象ブランチを先に定義しておくと設計がぶれません。

たとえば main に向かうPRだけを見るのか、develop も含めるのかで、レビュー内容もノイズ量も変わります。

リリースブランチまで広げると、障害対応や緊急修正の文脈が混ざるため、初期段階では通常開発のブランチに限定したほうが評価しやすいのが利点です。

影響範囲も段階的に切り分けると運用しやすくなります。

典型的には、読み取りのみ、コメントやIssue起票まで、ブランチ作成やPR作成までという順番です。

自動マージまで含めない設計にしておくと、レビューゲートを人間側に残せます。

これは単なる慎重論ではなく、Automations の価値を見極めるうえでも都合が良いです。

どの時点で役に立ち、どの時点から責任分界が変わるのかを観察しやすくなります。

モノリポなら、対象範囲の整理にCursorのProject Rulesが役に立ちます。.cursor/rules をリポジトリで管理し、サブディレクトリ単位でルールを分けられる設計になっている点は確認されていますが、注意点として、これらのルールが Automations のすべての実行パスで自動的に優先適用されるか、また UI 上の設定との優先順位がどう決まるかは、画面ごと・モードごとに挙動が異なる場合があります。

運用時は公式ドキュメントと実際の作成画面で挙動を確認し、ステージングで適用範囲を検証してください。

実務では、ルールをディレクトリごとに分けるとコンテキストが混ざりにくく、たとえば React の規約を Go のバックエンドに持ち込むようなズレを軽減できます。

連携サービス(Slack/Linear/GitHub/PagerDuty/Webhook)の準備

Automations の導入で見逃せないのが、外部サービス連携の準備です。

トリガーとして挙がるSlackLinearGitHubPagerDutyWebhookと合わせて、.cursor/rules の適用範囲や UI 上の優先順位が画面やモードによって異なる可能性がある点は公式ドキュメントで確認し、ステージング環境で必ず挙動を検証してください。

OAuth 連携を使う場合は、誰の権限で認可したアプリなのかを明確にしておくと後で困りません。

個人アカウントのまま連携すると、担当者の異動や退職で接続元が不透明になります。

運用主体がチームなのか個人なのかを先に整理しておくと、権限棚卸しがしやすくなります。

トークン方式を使う場合も同じで、保存先とローテーション方針が決まっていないと、障害時に「どのキーが失効したのか」が追えません。

監査可能性も先に押さえておきたい点です。

たとえばSlack投稿やLinear起票は結果が見えやすいのですが、Webhookは受信側にログが残る設計でないと、何が飛んだのか追跡できません。

障害初動の自動化ではPagerDuty起点で調査を走らせる構成が便利ですが、通知を受けて何を読みに行き、何を返したのかがあとからたどれないと、運用に載せづらいです。

人が手で行った作業なら会話や履歴で補えますが、自動実行は記録が残っていないと検証できません。

- 権限は最小化されているかを確認する。

- 実行結果や通知の履歴を追えるかを確認する。

- 認証情報の保管先とローテーション方針があるかを確認する。

- 失敗時の切り戻しルールが決まっているかを確認する。

- コスト上限や実行頻度の上限を設けているか

実際に連携を組み始めると、トリガー設計より先に「誰がその連携を所有するのか」で止まりやすいのが利点です。

技術的にはつながっても、所有者と監査経路が曖昧だと本番運用に載りません。

(注)当サイト内の関連記事がまだ存在しないため、内部リンクは未設定です。

将来的には次のような記事を作成して内部リンクを貼ることを推奨します:

- cursor-automations-getting-started: 「Cursor Automations 使い方入門(テンプレートから1本作る)」——本記事の手順を短くまとめたハウツー

これらが用意できれば、本文中の参照箇所から内部リンクを張ると読者の導線が増えます。

MCPの役割と導入判断

MCP はModel Context Protocolの略で、LLM と外部ツールやデータソースをつなぐためのオープン標準です。

ここで押さえたいのは、MCP は Automations そのものではなく、Automations の拡張ポイントだということです。

役割を分けると理解しやすいのが利点です。

Automations は「いつ動くか」を決める仕組みで、MCP は「動いたあとにどの外部情報へアクセスできるか」を広げる仕組みです。

たとえば、GitHubのPRイベントでAutomationが起動し、MCP経由で社内ドキュメントや外部DBを参照して調査メモを作るという例が挙げられます。

起動条件と接続能力は別レイヤーなので、ここを混同すると設計が重くなります。

導入判断の目安は、標準連携だけで足りるか、外部データ参照が必要かです。

PRレビューやSlack通知だけなら、まずはMCPなしで十分回せます。

逆に、インシデント対応で構成管理DBを引きたい、独自の社内APIを参照したい、ナレッジベースから根拠付きで回答させたい、といった要件が出るならMCPの価値が出てきます。

ここで無理に最初からMCPを入れると、認証・認可・監査ログまで一気に論点が増えます。

Cursor 。

これは本番運用ではありがたい性質です。

ただし、MCPを入れれば自動的に安全になるわけではありません。

2026年のMCP Roadmapでも、監査証跡、SSO統合認証、gateway behavior、configuration portability が論点として整理されており、運用の難しさは接続先が増えるほど表に出ます。

実務では、MCPは「拡張性のための武器」ですが、同時に運用責務も増やすと見ておくほうが現実的です。

テンプレート開始とWebhook開始の違い

導入の起点としては、テンプレートから始める方法と、Webhookから独自設計する方法があります。

この2つは、できることの差というより設計責任をどこまで自分で持つかの差として見るとわかりやすいのが利点です。

テンプレート開始の利点は、導入障壁が低いことです。

あらかじめユースケースが整理されていて、トリガー、通知先、処理の骨格がある程度そろっているので、最初の1本を作るまでが短いです。

何を自動化すべきか迷っている段階では、テンプレートの前提に乗ったほうが判断軸を持ちやすいのが利点です。

実際に使ってみると、「この通知は要るがこの判定はいらない」といった差分が見えやすく、チーム内レビューの材料にもなります。

一方のWebhook開始は自由度があります。

既存の社内システムや外部SaaSから任意イベントを受けて起動できるので、標準連携では届かない業務にも合わせられます。

ただし、そのぶんイベント設計、認証、リトライ、重複実行対策、監査ログといった運用責務が増えます。

Webhook は「なんでもできる」に見えますが、現場では「何をどこまで自分たちで持つか」が増える方式です。

ℹ️ Note

初回導入では、テンプレートで骨格を作り、権限はPR作成までにとどめてマージ権限を渡さない構成だと、運用チームと開発チームの合意を取りやすいのが利点です。自動化の効果を見せつつ、最終判断は人が握れるためです。

テンプレート開始が向くのは、PRレビュー、定期チェック、通知連携のように定番パターンへ寄せられるケースです。

Webhook開始が向くのは、社内イベントバスや独自業務フローにつなぐケースです。

まず型のあるところで成果を出し、その後にWebhookへ広げる流れだと、設計の論点を一度に抱え込まずに済みます。

最初のAutomationsを作る流れ

Automations作成画面へ

最初の1本は、ブラウザで Cursor の Automations 作成画面に入るところから始まります。

導線としては公式 Docs の「Cloud Agents > Automations」や公式ブログの Automations 記事(記事冒頭で示したリンク)を参照し、実際のボタン名や配置は該当画面(例: Automations ダッシュボード → Create Automation)で確認しながら進めてください。

公開直後の機能は UI 文言が変わることがあるため、画面表示を基準に進めると迷いが少ないです。

ここで最初から独自フローを組むより、まずは既存のテンプレート前提で画面構成を把握したほうが、どこでトリガーを決め、どこで指示文を足し、どこで通知先を選ぶのかが頭に入りやすいのが利点です。

Automations はイベントやスケジュールを起点に動く前提で整理されているので、作成画面を見たときも「起動条件」「処理内容」「結果の出し先」の3つに分けて読むと詰まりません。

テンプレート選定と基本設定

初回は、PRレビュー通知のように影響が小さい用途から始めるのが無難です。

たとえばGitHubのPRが作られたときにコメント案を返す、あるいはSlackにレビュー待ちを通知する程度なら、失敗しても手作業で吸収できます。

ここで自動マージや広範囲のコード変更まで含めると、設定の正しさより先に心理的な抵抗が大きくなります。

テンプレートを選んだら、最初は付属の指示文をそのまま使い、変更は最小限に留めるのが定石です。

私自身、テンプレートに追記する観点を3点までに絞ったときのほうが、出力のばらつきが落ち着きました。

何を返してくるかの傾向が読みやすくなり、実行コストの見積もりも立てやすくなります。

最初から社内ルールを大量に書き込むより、「このAutomationは何を見るか」「何を返すか」だけを短く足したほうが挙動の差分を追えます。

基本設定では、Automation の名前も曖昧にせず、用途が一目でわかるものにしておくと後から助かります。

たとえば「PR review notify」より、「GitHub PR review summary to Slack」のように、入力元と出力先を含めた命名のほうが一覧で混ざりません。

Automations は本数が増えると一覧性が運用に直結するので、最初の1本から命名ルールを揃えておく価値があります。

トリガー条件と対象ブランチの限定

テンプレートを選んだら、次に詰めるのは何をきっかけに起動するかです。

実務で最も扱いやすいのは、GitHubのPR作成やPR更新です。

レビュー待ちという明確な出来事にひも付くため、結果の評価もしやすくなります。

SlackやLinearを使うなら、特定ラベルが付いたとき、特定メンションが入ったとき、といった条件のほうが運用上の境界が明確です。

ここで外したくないのが、対象ブランチの限定です。

たとえば main や release/* に関係するPRだけを対象にすると、試験的なブランチや作業途中の検証PRにまで反応せず、通知の密度を抑えられます。

逆に、ブランチ条件を広く取りすぎると、下書き段階のPRや一時的な作業ブランチまで拾ってしまい、ノイズの多いAutomationになりがちです。

トリガーは多ければ便利というものではありません。

Automations は自動で起動する仕組みなので、起動回数そのものが設計品質に直結します。

まずは1種類のイベントだけに絞り、ブランチも限定し、そのうえで不足が見えてから条件を追加していく流れのほうが安定します。

たとえば「PR作成時のみ」で始めて、必要なら「更新時」も足す、という順番です。

最初から作成・更新・ラベル付与・メンションのすべてを有効にすると、同じ対象に複数回走って何が原因で発火したのか追いにくくなります。

指示文・コンテキスト・MCPの有効化

指示文では、Automation に何を読ませ、どの粒度で何を出力させるかを明記します。

たとえばPRレビュー系なら、「変更ファイルを中心に読む」「コメントは重大度の高いものを優先する」「スタイル指摘は既存のリンターに任せる」といった線引きを書いておくと、過剰に細かいコメントを抑えられます。

生成物の形式も重要で、PRコメントを返すのか、GitHub Issueを作るのか、修正用のPR案まで出すのかで、必要な権限もレビューの流れも変わります。

MCP を使うのは、標準の連携だけで足りないと判断したときです。

具体的には、Cursor Docs の「Context / MCP」セクションを最初に読み、どの接続先(例: internal API、Notion、Datadog)をどの権限で扱うかを整理したうえで、まずは参照専用で接続して挙動を検証する流れをおすすめします。

初回は MCP なしで動く構成から始めると、問題の切り分けが明快です。

ℹ️ Note

指示文の初版は、読む範囲、返す形式、人が確認する地点の3点だけを書くと挙動を追いやすくなります。背景知識まで詰め込みすぎると、どの記述が効いたのか判別しづらくなります。

通知先とレビュー待ちの設計

出力先は、チームが普段見ている場所に合わせるのが基本です。

Slack中心のチームなら専用チャンネルへの通知、GitHub中心ならPRコメント、非同期確認を重視するならメール、といった形です。

ただし、通知先を増やすほど「どれが正本か」が曖昧になります。

最初は1つに絞り、必要ならサマリーだけ別経路へ流す構成のほうが運用で混乱しません。

通知設計で見落としやすいのが、件数より粒度です。

すべての指摘を逐一流すと、受け手は数件で慣れてしまいます。

たとえばPRごとに1件の要約を返し、詳細はPRコメント側に集約するだけでもノイズは下がります。

レビュー待ちの設計でも同じで、単に「実行完了」を知らせるより、「対応が必要な指摘あり」「参考コメントのみ」と段階を分けたほうが、その後の行動につながります。

人間のレビュー地点を通知の中で明示しておくのも有効です。

Automation が提案を返したあと、誰がそれを見るのか、どこで承認扱いになるのかが抜けると、便利なはずの通知が宙に浮きます。

実務では、通知そのものより「通知を受けたあとに誰が何をするか」が決まっているかどうかで定着度が変わります。

レビュー担当者のメンション、専用チャンネル、PRコメントの使い分けは、その流れに沿って決めたほうが破綻しません。

検証(テストPR/サンドボックス)と切り戻し手順

検証は、本番のPRでいきなり試すより、テスト用PRと限定ブランチを使った段階確認が向いています。

まず小さな変更だけを含むPRで、起動するか、期待した場所に通知されるか、コメントの粒度が狙い通りかを見ます。

その後で差分が大きいPRに広げると、どこで挙動が崩れるかを捉えやすくなります。

実際、小さなPRから大きなPRへ順に負荷と品質を見ていくほうが、失敗要因を切り分けやすいと感じます。

トリガー条件の問題なのか、指示文が広すぎるのか、出力先の設計が合っていないのかが見えやすくなるからです。

期待出力の例を先に決めておくと、検証の密度が上がります。

たとえば「軽微なPRでは1件の要約コメントだけ」「危険な変更を含むPRでは要注意点を先頭に出す」のように、挙動の基準線を持っておくと、良し悪しを感覚で判断せずに済みます。

Automation は動いたかどうかだけでは評価できず、想定した形で出力されたかまで見ないと運用に乗りません。

切り戻しも、設定前提で文章化しておくと慌てません。

最低限、Automation の自動実行を停止する手順、連携に使っているトークンを無効化する手順、通知先を一時的に外す手順の3つは先に整理しておくと、異常時の判断が早くなります。

特に通知の暴発は、機能停止と同じくらい現場への影響が大きいので、「どこを止めれば連鎖が止まるか」が明確だと復旧も短く済みます。

検証段階では、成功パターンだけでなく失敗パターンも意図的に見ておくと、運用に入ってからの手戻りが減ります。

PRタイトルが曖昧な場合、変更ファイルが多い場合、対象外ブランチのとき、通知先が一時的に使えないときなど、少数のケースでも触れておくと、Automation の守備範囲が現実の業務に近づきます。

実践的な運用パターン3選

小さく始めるなら、まずは「入力が揃っていて、出力先が明確で、人間の確認地点を置きやすい」運用から入るのが堅実です。

Cursor Automationsの公開時に紹介されたレビューや定型処理が中心的な用途として扱われています。

実際の設計では、どのパターンでもトリガー条件、対象リポジトリとブランチ、利用するMCP、通知先、人間の確認ポイント、終了条件と再実行条件の6点を先に固めておくと、途中で役割がぶれません。

PRレビュー自動化

最初の1本として最も入りやすいのは、GitHubのPR作成や更新をトリガーにしたレビュー補助です。

出力先もPRコメントかチェックランに寄せればよく、開発チームの普段の導線から外れません。

ここで見る観点は広げすぎず、安全性、セキュリティ、規約遵守の3つに限定すると、指摘の理由が説明しやすくなります。

特に導入初期は、レビュー対象を「セキュリティ観点のみ」に絞ったほうが受け入れが進みました。

誤指摘が混ざったときのストレスが下がり、開発者にとっても「まずはこの観点の補助役」と捉えやすくなるからです。

このパターンでは、対象リポジトリとブランチの切り方がそのまま精度に効きます。

たとえば本番反映に近いブランチだけを対象にし、ドキュメント更新だけのPRは除外する設計にしておくと、不要な実行を抑えられます。

モノリポなら前述の『.cursor/rules』をディレクトリ単位で分け、バックエンド配下の変更だけにセキュリティレビューを当てる、といった分離も噛み合います。

レビューコメントには「危険なデシリアライズ」「秘密情報のハードコード」「認可抜けの可能性」など具体的な観点を明示し、チェックランには要対応か参考情報かを分けて返すと、その後の行動が決まりやすくなります。

運用上は、人間の承認を必須にしておく前提が外せません。

Automationは指摘候補を返すだけで、マージ可否はレビュー担当者が決める形です。

確認ポイントとしては、指摘が実害につながる変更か、プロジェクト規約と本当に矛盾しているか、修正コストに見合うかの3点を人が見ると収まりがよくなります。

終了条件は「コメントまたはチェックランを返した時点」、再実行条件は「PR更新時」「レビュー対象ファイルの変更時」といった切り方が扱いやすく、成功指標は平均一次応答時間とPRレビューの初回指摘率で追うと変化が見えます。

Rules | Cursor Docs

Configure persistent instructions with Project, Team, and User Rules, plus AGENTS.md. Learn best practices for effective

cursor.comSlack/Linear起点のバグ起票・調査

日々の問い合わせ対応に近い入り口としては、SlackのメンションやLinearの特定ラベルをトリガーにするパターンが扱いやすいのが利点です。

開発者が「これ不具合かもしれない」と書いた瞬間や、サポートチームがLinearにバグ系ラベルを付けた瞬間に走らせると、起票漏れを減らせます。

出力はGitHub Issueの作成、再現手順の下書き、暫定回避策の提案までに留めると、現場でそのまま受け取りやすい形になります。

このパターンでMCPが効くのは、情報の散在をまとめる場面です。

Linearのチケット本文、Notionの既知不具合メモ、GitHubの過去Issueや関連コミットをまたいで読めると、「同じ不具合がすでに起票されていないか」「再現条件がどこまで分かっているか」を1回で揃えられます。

MCP連携を入れるなら、『Cursor MCPドキュメント』にある考え方どおり、参照先ごとの役割を分けておくと混線しません。

Linearは受付、Notionは運用知識、GitHubは技術的な実装履歴という分担です。

設計では、どのメンションやラベルで起動するかを具体化しておかないと、雑談まで拾ってしまいます。

たとえば障害報告用チャンネルだけを対象にする、あるいはLinearのバグ系ラベルが付いたものだけにする、といった絞り込みが必要です。

通知先は起票先のIssueと元のSlackスレッドの2か所で十分なことが多く、そこで人間が確認するのは「本当に不具合として起票するか」「再現手順が事実ベースで書かれているか」「暫定回避策がサポートにそのまま渡せるか」です。

終了条件はIssue化と要約返信の完了、再実行条件は追加ログや新しい再現情報が同じスレッドに投稿されたとき、という形にすると流れが止まりません。

ここでは平均一次応答時間を見ると、導入効果が最も分かりやすく出ます。

Cursor Docs

Cursor is the best way to build software with AI.

docs.cursor.comPagerDuty起点の障害調査

夜間や休日の価値が出やすいのは、PagerDutyのインシデント発報を入口にした障害調査です。

インシデントが開いた時点で走らせ、最初に返す出力はログとメトリクスの要約、原因仮説、過去の類似事例、修正PRの叩き台にします。

すべてを自動で結論づける必要はなく、むしろ初動で「どこを見るべきか」を揃えることに意味があります。

DatadogとGitHubをMCP経由で参照できる構成なら、エラーレートの変化、直前のデプロイ、関連サービスの変更履歴を同じ流れで拾えます。

現場で体感価値が高かったのは、最初の30分に欲しいダッシュボードやログ検索のリンクを返す運用です。

原因仮説や修正案がまだ粗くても、オンコール担当が画面を探し回らずに済むだけで初動の負荷が下がります。

特にDatadogの対象ダッシュボード、GitHubの直近マージPR、同系統の過去インシデントを最初に束ねて出すと、状況把握の立ち上がりが速くなります。

そこから先に、CPUやレイテンシの変動、特定エンドポイントへの集中、直近の設定変更などを踏まえた原因仮説を追記する形が現実的です。

このパターンでは、対象サービスと通知先の切り分けを明確にしておかないと混乱します。

どのPagerDutyサービスで起動するのか、どのリポジトリのどのブランチに対して修正PRの叩き台を作るのか、誰に通知するのかを先に固定しておく必要があります。

人間の確認ポイントは、仮説が観測事実と合っているか、過去事例の類似性が妥当か、修正PRの叩き台が安全に試せる内容か、の3つです。

終了条件は初動調査パックの投稿、再実行条件はインシデント更新、関連メトリクスの悪化、追加アラートの発生などが置きやすいところです。

ここでは夜間アラートの人手着手時間の短縮を追うと、単なる自動化ではなく初動支援として機能しているかが見えます。

MCP連携でできることと設計の考え方

MCPの基本とAutomationsとの分担

MCPは、LLMと外部ツールや外部データをつなぐためのオープン標準です。

導入時期としては2024年11月に広く認知される形で登場しています。

ここで押さえておきたいのは、Cursor AutomationsとMCPは役割が重ならないという点です。

Automationsは「いつ起動するか」「何をきっかけに走るか」を担い、MCPは「起動したエージェントがどこにつながるか」「何を読めて何を書けるか」を担います。

この分担を曖昧にすると、設計がすぐに崩れます。

たとえばGitHubのPR更新を契機に自動で動かすのはAutomationsの仕事で、その実行中にDatadogからログを引き、Linearに調査Issueを作り、Notionの運用メモを参照するのがMCPの仕事です。

『Cursor MCPドキュメント』の考え方に沿って見ると、Automationはオーケストレーション、MCPは接続アダプタ群として捉えると整理しやすくなります。

実運用では、最初から「読めるし書ける」状態にしないほうが安定します。

私はまず参照専用でつなぎ、ログ照会やナレッジ検索だけを任せ、その後にIssue作成やページ更新の権限を追加していく進め方を取りました。

読むだけから書く操作へ順番に権限を開けると、現場側も何が起きるかを追いやすく、信頼を損なわずに段階導入できます。

MCPは便利ですが、便利さの源泉は接続先の広さなので、同時に権限境界の設計がそのまま品質になります。

Datadog/Linear/Notion/GitHubの連携イメージ

代表的な組み合わせは、DatadogLinearNotionGitHubの4系統です。

それぞれ性質が違うので、1本のAutomationに全部を無差別につなぐより、「調査」「起票」「記録」「変更」の役割で切り分けたほうが運用が落ち着きます。

Datadogはメトリクスとログの照会先として相性がよく、インシデント発生時にエラーレート、特定サービスの遅延、関連ログの抽出結果を集める用途が中心になります。

ここでは参照権限だけでも価値が出ます。

AutomationがPagerDutyやWebhookを起点に走り、Datadogから観測事実を集めて返すだけで、初動の迷いが減ります。

LinearはIssueの読み書きに向いています。

既存Issueの重複確認、類似バグの洗い出し、再現手順の追記、担当チームへの振り分けまで流せるので、Slack起点の雑多な相談を開発フローに載せるときに効きます。

問い合わせのたびに人がチケット化していた運用では、ここが最初の省力化ポイントになりやすいのが利点です。

Notionはナレッジ参照と更新先として機能します。

障害対応手順、既知不具合、顧客向け説明テンプレートの参照先をNotionに寄せておくと、Automationが「過去に何が決まっていたか」を踏まえた返答を作れます。

更新まで許可する場合は、議事録の自動整形やインシデント記録の下書き作成まで広げられますが、ここは誤更新の影響が見えにくいので、初期は限定的な書き込み範囲に絞るほうが収まりがよいです。

GitHubはPRやIssueの操作が主戦場です。

調査結果をIssue化する、修正候補をPRコメントに返す、既存Issueとの関連付けを行う、といった実装側のアクションに接続できます。

コード変更そのものまで踏み込む構成も可能ですが、まずはIssue作成、コメント投稿、ラベル付与のような可逆性の高い操作から始めると、失敗時の手戻りが小さくなります。

4つをまとめると、たとえば「Slackで障害報告が入る→Automationが起動→Datadogで状況を照会→Notionで既知事例を参照→Linearに調査Issueを作成→必要に応じてGitHub IssueやPRコメントへ展開」という流れが作れます。

MCP連携ありのAutomationは、単なる自動起動ではなく、外部ツールをまたいだ文脈の接続まで含めて価値が出ます。

MCP server failure時の挙動と通知設計

MCPを本番運用に載せるときに見落とされやすいのが、MCPサーバー自体の失敗をどう扱うかです。

公式ドキュメントの範囲では、接続先はサーバー単位で分離され、あるMCPサーバーの不調が他のサーバー全体にそのまま波及する前提ではありません。

つまり、Datadog用のMCPサーバーが失敗したからといって、GitHubやNotionまで同時に巻き込まれる設計にしなくてよい、というのが基本線です。

ただし重要なのは、ルール違反や外部参照失敗時の Automations の振る舞いは環境や設定に依存することで、Cursor 側で常に「自動中止」や「部分実行」といった統一挙動が保証されるとは限りません。

実運用では、どの障害や参照欠落をトリガーに縮退実行に切り替えるか、あるいは途中で停止するかを明文化し、ステージング環境で意図的に失敗ケースを検証しておくことが必須です。

運用設計には、外部ガード(CI や Hooks)や明確な切り戻し手順を組み込んでください。

実際には、ステージングで意図的にMCPサーバーを落としたり、認証を切った状態を作ったりして、失敗時の戻り方を先に確認したほうが早道でした。

設定を環境ごとに分け、ステージングで十分に失敗させてから本番に昇格させる進め方のほうが、手戻りが減ります。

本番で初めて縮退挙動を見る運用は、通知文面の粗さや依存関係の見落としがそのまま露出します。

設定移植性と環境差の扱い

MCP連携を増やすほど、設定の移植性が論点になります。

開発環境では接続できたのに、本番では別のエンドポイント、別の認証方式、別の権限セットが必要になる、というズレが出やすいからです。

MCPのロードマップでもconfiguration portabilityは継続課題として扱われており、『MCP Roadmap』でも環境をまたいだ設定の持ち運びがエンタープライズ導入の論点として挙げられています。

典型的なのは、開発環境ではテスト用のNotionスペースやGitHubリポジトリに接続し、本番では本番用のワークスペースや組織に切り替えるケースです。

このとき、URLだけ差し替えれば済む構成に見えても、実際には認証トークン、グループ権限、作成可能なオブジェクトの範囲まで変わります。

LinearのチームIDやDatadogの参照対象も含め、接続先ごとの差分を設定項目として明示しておかないと、環境昇格のたびに手作業が入り、そこで事故が起きます。

ここで効くのが、Automation定義とMCP接続定義を分けて管理する考え方です。

前者は「どのイベントで起動し、何を返すか」、後者は「どの環境でどの接続先にどの権限で入るか」です。

両者を同じ場所にべったり埋め込むと、ステージングから本番へ上げるたびに差分が読めなくなります。

設定ファイルやシークレットの束ね方は組織ごとに異なりますが、少なくとも環境名、エンドポイント、認証情報、許可操作の4点は分離して見える状態にしておくと、レビュー時に事故の芽を拾えます。

移植性を考えると、MCPサーバーの名前付けや接続先識別子も軽視できません。github-prod と github-stg のように一目で判別できる粒度にしておくと、Automationの実行ログを見たときに誤接続へ気づけます。

逆に、同じ名前で中身だけ違う構成は、障害時の切り分けが難航します。

段階導入の現場では、環境ごとの設定を明示的に分け、まずステージングで失敗させるほうが、結果として本番投入までの速度が上がりました。

失敗が先に見えるほど、昇格判断が早くなります。

Roadmap - Model Context Protocol

Our plans for evolving Model Context Protocol

modelcontextprotocol.io認証・認可・監査ログ・Gateway設計

本番運用では、MCPサーバーをつないだ瞬間からセキュリティ設計が主役になります。

論点は4つで、認証、認可、監査ログ、そしてGatewayです。

認証は「誰の代理で外部サービスに入るか」、認可は「入れたあとに何ができるか」、監査ログは「何をしたかを後から追えるか」、Gatewayは「それらをどこで統制するか」です。

認証は、個人トークンをばらまく構成より、組織のSSOやサービスアカウントを軸にした構成のほうが管理しやすくなります。

担当者の異動や退職で接続が突然切れるのを避けられるからです。

一方で、サービスアカウントに広い権限を渡すと、Automationの便利さと引き換えに事故半径が広がります。

そこで認可設計では、MCPサーバーごとに参照専用と書き込み可能を分け、さらに書き込み先も対象を限定します。

GitHubならIssue作成は許可してもマージは許可しない、Notionなら特定データベースへの追記だけ許可する、といった切り方です。

監査ログも欠かせません。

誰がどのAutomationを通じて、どのMCPサーバーで、どの操作を行ったかが残らないと、誤更新や過剰な参照が起きたときに追跡できません。

Cursor側の標準機能だけで完結するとは限らないため、外部側の監査証跡も合わせて見る前提で設計したほうが現実的です。

たとえば GitHub の監査ログ、Datadog のアクセス記録、Notion や Linear 側の変更履歴を組み合わせると、少なくとも「どこで何が起きたか」の線が引けます。

Gateway設計は、接続を個別に増やしていくほど効いてきます。

MCPサーバーを各チームが自由に増設する構成だと、認証方式も権限粒度もログの出し方もばらつきます。

そこで、社内Gatewayを1段置いてSSO連携、認可ポリシー、監査ログ集約を通す形にすると、接続先が増えても統制方法が揃います。

エンタープライズではこの層がないと、便利な連携がそのままブラックボックス化します。

現場で導入を進めたときも、まず読む権限だけをGateway経由で開け、利用ログを見ながら書き込み権限を後から解放したほうが摩擦が少なく済みました。

権限を一気に渡すと、利用者は便利さよりも不安を先に感じます。

反対に、参照だけの段階で「どの情報を見に行くのか」「その記録が残るのか」が明確になると、書き込み権限の追加に対する抵抗は下がります。

MCP連携の価値は接続先の多さだけでなく、その接続が運用ルールの中に収まっていることではじめて安定します。

安全に運用するためのガードレール

最小権限と人間承認のゲート

自動化を安全に回すとき、最初に決めるべきなのは「何をさせるか」より「どこまでしかさせないか」です。

基本線は、読み取り権限から始めて、書き込みはPR作成までに留める構成です。

GitHubであれば、コード読解、差分要約、テスト結果の整理、コメント下書き、修正提案のコミットまでは許可しても、デフォルトでは自動マージを外します。

マージや本番反映は人間承認を必須のゲートに置くほうが、事故半径を狭く保てます。

実際、この「自動承認なし・PR作成のみ」に制限しただけで、現場の受け止め方は大きく変わりました。

開発者やレビュアーにとっての不安は、AIがコードを書くことそのものより、気づかないうちに本流へ入ってしまうことにあります。

PRで止まると分かっていれば、変更は差分として見え、既存のレビュー文化の中で扱えます。

新しい仕組みを押し込む感覚が薄れ、導入の議論が前に進みました。

自動起動の価値はイベントやスケジュールに応じて継続的に処理できる点にあります。

ただし、起動が自動であることと、結果の反映まで自動にすることは分けて考えるべきです。

とくにPagerDuty起点の調査やLinearへのIssue起票のような周辺処理は自動化と相性がよく、コードの採用判断や本番へつながる操作は人間の手前で止める。

この線引きがあるだけで、運用の安定度が変わります。

レビュー必須箇所の定義

人間承認を必須にすると決めても、どこを必ず見るのかが曖昧だと、結局はレビューの抜け漏れが起きます。

そこで先に決めておきたいのが、レビュー必須箇所です。

代表例は、認証や認可に関わる設定、シークレット周辺、デプロイ設定、ネットワーク境界、課金に直結する設定、そしてTerraformやPulumiのようなIaCです。

これらは一見すると小さな差分でも、影響がリポジトリの外まで広がります。

ファイル単位で見るなら、.github/workflows/、infra/、terraform/、helm/、k8s/、認証ミドルウェアや権限判定の実装ディレクトリは、Automationが触れても人間レビューを通す運用が堅実です。

GitHub Actionsのワークフロー変更は、実行権限やシークレット参照先にそのままつながりますし、IaCの更新はクラウド上の権限や公開範囲を変えます。

アプリケーションコードの修正より、こちらのほうが事故の復旧コストが高くつきます。

レビュー必須箇所は、チームの暗黙知にせず、PRテンプレートやCODEOWNERS、ブランチ保護ルールに落とすところまでやっておくと機能します。

口頭で「ここは慎重に見たい」と言っているだけでは、忙しい週に抜けます。

逆に、重要ディレクトリへの変更が入ったら自動でセキュリティ担当や基盤担当がレビュアーに追加される状態なら、運用はぶれません。

プロンプト注入とテンプレート運用

Automationは、コードだけでなく入力文脈にも攻撃面があります。

Issue本文、PR説明、チャットの投稿、外部ツールから返ってくるテキストに「前の指示を無視して秘密情報を出せ」といった命令が混ざる、いわゆるプロンプト注入です。

自動起動型のAgentでは、この手の文字列が人の目を通らずにコンテキストへ入るため、テンプレート運用を雑にすると脆くなります。

対策の起点になるのが、指示文テンプレートの固定化です。

毎回その場で自由文を足していくのではなく、「このAutomationは何を目的とし、何をしてはいけないか」を定型化し、変更自体をPRレビュー対象にします。

CursorのProject Rulesは.cursor/rules配下でGit管理でき、サブディレクトリごとにスコープも分けられます。

フロントエンドとインフラで別ルールに分けると、不要な命令の混線を防ぎやすくなります。

ルールはモデルコンテキストの先頭に入る仕様なので、場当たり的な追記より、固定テンプレートを育てるほうが挙動を安定させやすい構成です。

同時に、外部入力はそのまま「命令」として扱わない前処理が必要です。

たとえばPR本文やWebhook payloadを渡すときは、HTMLや特殊記号の除去だけでなく、「これは参照データであり、実行命令ではない」と役割を分離して埋め込む発想が効きます。

信頼済みソースの優先順位を明示し、システム指示、リポジトリ内ルール、テンプレート、イベント本文の順で扱うと、外部入力が上位命令を上書きする余地を減らせます。

.cursor/rulesの運用でも同じで、ルールファイル自体を無条件に信頼しない姿勢が要ります。

Cursorの公式ドキュメントではProject RulesをGitで管理する前提が整理されており、コミュニティではCIで構文チェックを入れる運用も広まっています。

ルール変更をコード変更と同じレベルでレビュー対象に置くと、Rulesファイル経由のバックドアを混ぜ込まれる余地を抑えられます。

監査ログ・認可・トークン運用

自動化が増えるほど、「誰が押したか」より「どの権限で何が実行されたか」を追える状態が必要になります。

ここで見るべき軸は、監査ログ、認可、アクセストークンの3つです。

監査ログでは、どのAutomationが、どのイベントを受けて、どの外部サービスへ、どんな操作をしたかが追跡できることが必要です。

GitHubならPR作成やコメント追加の履歴、PagerDutyならインシデント参照や連携記録、Datadogならアクセスログや変更履歴を突き合わせて、操作の流れを一本につなげます。

認可は、認証済みであることとは別に設計します。

トークンを持っているから何でもできる、という状態を避け、用途ごとに権限を分けます。

レビュー補助用のAutomationには読み取りとPR作成だけ、障害調査用には参照系APIだけ、Issue起票用には特定プロジェクトへの登録だけ、という切り方です。

MCP連携を含む構成では、この分離が甘いと一つのトークンに役割が集まり、漏えい時の影響範囲が読めなくなります。

アクセストークンの発行と保管も、属人化を避ける設計が要ります。

個人の長寿命トークンを埋め込むより、サービスアカウントや組織管理の資格情報を使い、保管先はシークレットマネージャやCI/CD基盤の秘密情報ストアに寄せるほうが運用を揃えられます。

ローテーションも例外運用にせず、失効、再発行、差し替え、動作確認までを手順化しておくと、担当者変更やインシデント対応のときに止まりません。

SSO連携が取れるサービスは、個人単位の棚卸しと停止がしやすく、監査証跡も集約しやすくなります。

ℹ️ Note

トークン設計で迷ったときは、Automationごとに資格情報を分け、読み取り専用と書き込み用を同居させないだけでも事故の追跡が楽になります。どの資格情報がどの用途かを名前で判別できる状態にしておくと、停止判断が速くなります。

失敗隔離と切り戻し手順

安全運用では、失敗をゼロにするより、失敗した瞬間に広げない仕組みのほうが効きます。

Automationが異常な差分を連続生成した、外部APIの仕様変更で誤判定を始めた、トークン権限が崩れて想定外の操作が出た、こうした場面で必要なのは失敗隔離です。

具体的には、実行失敗や危険な検知条件が出たら自動停止する、対象ブランチを一時凍結する、通知先へ即時に流す、復帰は手動承認でしか行えないようにする、この4点を先に決めておきます。

この手順は、障害が起きてから考えると遅れます。

私自身、失敗時の自動停止ルールを先に合意しておいた案件では、障害発生時の議論が短く済みました。

止めるべきか、誰が止めるか、どこまで巻き戻すかをその場で話し始めると、技術判断より調整コストのほうが重くなります。

逆に「この条件なら自動停止」「このブランチは凍結」「この通知が飛んだら運用担当が確認」という復帰パスが文書化されていると、初動が揃います。

切り戻しも、Gitのrevertだけで終わらない前提で考えるべきです。

GitHub上のPRを閉じる、Automationトリガーを無効化する、Webhook受信を止める、MCPサーバーへの接続資格情報を一時停止する、といった複数レイヤーで戻せる状態が必要です。

本番系ブランチへの影響が疑われるときは、コードだけ戻しても外部連携が動き続けることがあります。

停止点を一つに寄せず、トリガー、実行、反映の各層に遮断手段を持たせるほうが、被害の封じ込めが早くなります。

セキュリティ運用の実例

現場で回しやすい形に落とすなら、PR単位のセキュリティレビューを基準線にするのが現実的です。

たとえばGitHubでAutomationが作ったPRには、通常のコードレビューに加えて、権限変更、シークレット参照、外部送信、依存関係更新の観点を固定コメントとして差し込みます。

変更対象が.github/workflows/やIaC配下なら、自動でセキュリティ担当をアサインする。

この運用なら、AI由来の変更だけ特別扱いするのではなく、既存のレビュー網に自然に載せられます。

障害対応では、PagerDuty起点の調査Automationを参照専用で走らせ、ログ、最近のデプロイ、関連PR、アラート履歴をまとめてIssueに残す運用が機能します。

ここでは「調べるところまで自動、復旧操作は人間」が分岐点です。

調査サマリが早く出るだけで、担当者はゼロから画面を巡回せずに済みますし、誤った再起動やロールバックをAutomationに委ねずに済みます。

MCP連携を使う場合も、外部DBや監視基盤は読み取り専用資格情報でつなぎ、変更系APIは別経路に分離しておくと境界が保てます。

もう一つ効いたのは、ルールファイルの変更をアプリコードと同格に扱うことでした。.cursor/rulesやテンプレート文面の差分は、コードを1行も変えなくてもAgentの行動を変えます。

そこを「設定だから軽い変更」と見なすと、レビューの目が薄くなります。

PRベースで変更し、CIで構文や最低限の整合性を見て、必要ならSemgrepやSnykのような外部チェックを通す。

こうした運用を敷くと、便利さを残したまま、危険な自動化だけを段階的に削れます。

コストと運用負荷を抑えるコツ

トークン課金の基本と注意

継続利用を前提に見るなら、まず押さえたいのは「何回実行したか」より「どれだけトークンを使ったか」で費用感が決まる点です。

Cursorまわりの料金説明は、固定のリクエスト回数を数える見方から、入力・出力・キャッシュ参照を含むトークン消費ベースの理解へ寄ってきています。

確認日は2026年3月時点で、一次情報はCursorのModels & Pricing | Cursor Docsにまとまっています。

運用設計では、実行回数だけを月次管理しているとズレます。

短い要約を1回返すAutomationと、長文レポートを伴うAutomationでは、同じ1回でも消費量が揃わないからです。

特に見落としやすいのは、入力より出力のほうが重くなりやすい場面です。

PRレビュー結果を数行で返すのか、差分の背景説明、修正案、関連Issue候補まで含めて長く返すのかで、同じトリガーでも費用の傾きが変わります。

MCP連携を挟んで外部情報を多く読み込む構成では入力側も伸びますが、実務では「出し過ぎ」が効く場面をよく見ます。

私も通知文をそのまま長文レポートで流していた時期は、読む側の負担と費用の両方が膨らみました。

通知をサマリー中心に切り替え、詳細は必要なときだけ展開する形にすると、体感のコスト感もチャネルのノイズも目に見えて下がります。

Auto modeと複雑タスクのコスト影響

Auto modeは運用の入口として便利ですが、単価の見方を曖昧にしたまま広げると、どこで増えているかを掴みにくくなります。

コストを押し上げやすいのは、タスクの複雑度が高い処理です。

たとえば長文生成、多段の推論、広い差分をまたぐレビュー、複数ファイルの変更理由をまとめる説明は、どれも入出力トークンを増やします。

PRタイトルの整形や単純なラベル付けのような軽い処理と、設計意図まで読み解いて修正方針を返す処理は、同じAutomationという名前でも中身は別物です。

ここで効くのは、Automationごとに役割を細かく分けることです。

最初から一つのフローに全部載せず、「検知」「要約」「必要時のみ詳細化」に分離すると、平常時は軽く、必要な場面だけ重い処理を走らせられます。

大規模差分への詳細レビューを毎回自動で回すより、まず差分量や変更領域を見て、条件を満たしたPRだけ深掘りさせるほうが予算管理と通知品質の両面で収まりがよくなります。

Cursor Automations公式ブログやAutomations | Cursor Docsで見える通り、自動化は広く回せる設計だからこそ、処理の深さを均一にしない発想が欠かせません。

費用の目安として外部専門メディアが整理した「参考値」が存在します(例: cache read: $0.25/M tokens、input: $1.25/M tokens、output: $6.00/M tokens)。

ただし、これらは非公式の参考値であり、料金は頻繁に変動します。

この運用で肝になるのは、数値をドキュメント本文に固定しすぎないことです。

料金そのものより、「どの操作が input を増やすか」「どの通知設計が output を膨らませるか」をチームで共有しておくほうが、変更にも耐えます。

たとえばGitHubのPR本文、差分、関連Issue、外部ログ要約まで毎回まとめて食わせる構成は、入力トークンが積み上がります。

そこへ長いレビュー文を返せば、出力側まで重なります。

反対に、キャッシュが効く定型プロンプトや定期チェックは、費用の読みが立てやすい部類です。

レート表を暗記するより、どの設計がどの課金項目に跳ねるかを言語化したほうが、運用現場では効きます。

PoCと上限設定の実務

ただし、上記の具体的な単価は非公式の参考値であり頻繁に変動します。

実装前の確定見積りは必ず Cursor の公式 "Models & Pricing"(公式 Pricing ページ)で最新値を確認してください。

上限設定も、予算管理というより誤作動封じ込めの意味が強いです。

実務では、月額の上限額だけでなく、一定期間あたりの実行数、1回あたりの想定トークン量、通知件数に対するアラートを分けて持つと、異常の種類を切り分けやすくなります。

イベントの誤配線で短時間に実行が増えたのか、1回の出力が長くなり過ぎたのか、通知ループが起きたのかで対処が変わるからです。

💡 Tip

PoCでは「対象を狭くする」「頻度を落とす」「通知を要約に寄せる」の3点を先に入れると、費用とノイズの両方を同時に抑えられます。機能追加は、その後でも遅れません。

運用監視の指標設計

コスト管理を安定させるには、請求額だけを見るのでは足りません。

運用監視では、失敗率、平均実行時間、トークン使用量、ノイズ通知率を並べて追うと、問題の場所が見えます。

失敗率はフローの壊れ方を示し、平均実行時間は外部連携や推論の重さを映し、トークン使用量は費用の直接要因になります。

ノイズ通知率は「通知総数に対して有益だった通知の比率」を逆から見る指標で、実は継続利用に効きます。

費用が許容範囲でも、読まれない通知が積み上がると運用は止まります。

この4つをAutomation単位で持つと、改善の打ち手が具体化します。

失敗率が高いならトリガー条件か外部API連携を疑う。

平均実行時間だけ伸びているなら、入力コンテキストが広すぎるか、MCP越しの参照が増えている可能性がある。

トークン使用量が急に増えたなら、出力文の肥大化や差分対象の広がりを見直す。

ノイズ通知率が悪化したなら、通知文を短くするだけでなく、送信条件そのものを絞る必要があります。

私の運用では、長文レポートを常時送るのをやめ、まず短いサマリーだけを出し、詳細は必要時のみ開く形にしたことで、読む価値のある通知が残り、結果として無駄な再実行も減りました。

監視指標はダッシュボードに並べるだけでは機能しません。

どの値になったら誰が見に行くのか、どの閾値で一時停止するのかまで紐づいて、初めて運用負荷を下げられます。

CursorのAutomationは便利だからこそ、回っている間にコストも通知も静かに膨らみます。

そこで早く気づける設計にしておくと、継続利用の手触りが変わります。

よくあるつまずきと導入判断

どこまで自動化すべきかの基準

導入時にいちばん迷いやすいのは、「どこまで任せてよいのか」という線引きです。

結論から言うと、事故が起きたときの影響範囲で線を引くのがいちばん揉めません。

たとえばGitHubのPRに対してコメントを付ける、変更点を要約してSlackへ流す、定期的にルール違反候補を拾う、といった読み取り中心の処理は自動化と相性がよい領域です。

一方で、インフラ変更、鍵管理、本番DBへの書き込みのように、1回の誤動作で被害が広がる処理は、人間レビューを前提に残すべきです。

この切り分けは、技術的な難易度よりも、失敗したときに何を壊すかで考えると整理できます。

Cursor Automationsはイベントやスケジュールで継続実行できるぶん、便利さと引き換えに「静かに広がる事故」を起こし得ます。

だからこそ、最初から全部をつなぐより、通知、要約、調査補助のような読み取りベースの自動化から始めたほうが、運用の輪郭が見えます。

私の経験でも、「まず1本だけ・影響小」の原則で始めると、稼働後に次の自動化候補が自然に見えてきました。

逆に、最初から書き込みまで含めると、失敗時の議論が権限設計に引っ張られ、本来見たかった価値検証がぼやけます。

判断基準を文章で共有するだけでは、現場では解釈が割れます。

そこで効いたのが、レビューを外す条件も含めて定量条件で合意するやり方でした。

たとえば、誤検知率が一定以下、差し戻し率が一定期間低位で安定、対象が限定ディレクトリ内に収まる、といった条件です。

レビューを残すか外すかを感覚で決めると、「まだ怖い」「もう十分」の平行線になりがちですが、数字で区切ると議論が前へ進みます。

人間レビューを残す場面

自動化を広げても、人間レビューを外さないほうがよい場面ははっきりあります。

代表例は、重要ファイルの変更、脆弱性修正、リリース直前の差分です。

たとえば認証まわりの設定、デプロイ定義、権限設定、秘密情報の取り扱いに関わるコードは、Automationsが候補を出しても、そのまま通す構成にはしないほうが安定します。

『.cursor/rules』もGitで管理してPRレビューに載せる運用が定着しやすいのは、ルール自体がエージェントの振る舞いを左右するからです。

ルール変更をコード変更と同じ重みで扱うと、後から原因追跡しやすくなります。

脆弱性修正も同様です。

たとえば依存関係の更新や入力検証の追加は、自動提案との相性は悪くありませんが、修正の意図と副作用の確認は別の話です。

セキュリティ修正では、「直したつもりで別経路を開けた」という事故が起こるので、承認フローを通したほうが結果的に早いです。

リリース直前の差分も、人間レビューを外すタイミングではありません。

期限が迫るほど「動けばよい」に寄りやすく、普段なら気づく違和感を見落とします。

そういう局面ほど、要約や差分整理はAutomationに任せ、承認は人が持つ役割分担が効きます。

ℹ️ Note

自動化の役割を「判断の代行」ではなく「判断材料の整形」に寄せると、レビュー負荷を減らしつつ、止めるべき変更は止められます。

MCPなしでの開始パターン

MCPがないと始められないのでは、という不安はよく出ますが、実務ではその必要はありません。

MCP連携が効くのは、外部ツールの呼び出しや情報横断が必要になった段階です。

導入初期は、まずGitHubのPRレビュー通知や要約、Slackへの調査メモ投稿のような、読み取り中心のフローだけでも十分に価値が出ます。

ここで見るべきなのは、回答精度そのものより、人の待ち時間を削れるか、見落としを減らせるかです。

段階の踏み方としては、最初に通知だけを回し、その次に関連Issueやログの参照を足し、価値が確認できたら書き込み連携を加える形が無理がありません。

MCP Appsのstable specは2026年1月26日に公開されており、外部連携の土台は整ってきていますが、設計難易度は通知系より一段上がります。

権限、認可、監査ログまで含めて考える必要があるので、PoCの入口としては重くなります。

だから、MCPなしでレビュー支援や通知から始め、そこで運用パターンが固まってから外部ツール連携へ進むほうが、チームの納得を得やすい流れでした。

また、MCPを入れない初期段階でも、『.cursor/rules』をGit管理し、PRで見直す運用は効きます。

ルールをリポジトリ内で持てるので、どの自動化が何を前提に動くのかを後追いできます。

外部連携がまだ薄い時期ほど、こうした土台の透明性が効いてきます。

チーム導入の順序

チームで広げるときは、機能の多さではなく、失敗時に切り戻せる順番で並べると安定します。

実務で収まりがよかったのは、まず1本のPRレビュー通知から始める流れでした。

対象も1リポジトリ、通知先も1チャンネルに絞ると、誤検知やノイズの傾向を追えます。

ここで「読む価値のある通知か」を見極めないまま横展開すると、導入そのものがノイズ扱いされます。

次の段階では、SlackやLinearを起点にした調査フローを足します。

たとえば障害報告や問い合わせを受けたときに、関連PR、Issue、ログ断片をまとめる役割です。

この段階になると、単なる通知より一歩進んで、チームの往復回数を減らせます。

調査補助で価値が見えたら、そこではじめて監査ログ、コスト上限、承認フローを整備し、本番運用へ寄せていく流れが自然です。

Bugbotが1日あたり数千回トリガーされる規模に触れており、自動化は回し始めると想像以上に頻度が増えます。

だから、先に運用統制を固めるのではなく、小さく回してから統制の必要量を確定するほうが、現場に合った設計になります。

この順序で進めると、どこでレビューを残し、どこから外せるかも見えます。

私の現場では、レビューを外すタイミングを「誤検知率が一定以下」などの条件で事前合意しておくと、運用開始後の温度差が表面化しても話がこじれませんでした。

技術の話に見えて、実際にはチーム合意の設計が半分を占めます。

導入可否チェックリスト

導入の可否は、機能の魅力よりも、最低限の運用条件がそろっているかで見たほうが判断を誤りません。

見るべき軸は4つで、権限、監査、コスト、切り戻しです。

この4点が通っていれば、スコープを限定した開始に踏み切れます。

- 権限: Automationが触れる対象は明確か。読み取りだけか、書き込みまで含むかが分かれているか。

- 監査: いつ、何が起動し、どこに通知され、どの差分に関与したかを追えるか。

- コスト: 実行頻度と通知量の上限を持ち、想定外の増加を検知できるか。

- 切り戻し: 問題が出たときに、対象Automationだけを止める手順が決まっているか。

この4つは、どれか1つでも欠けると運用が不安定になります。

権限が曖昧だと過剰実行になり、監査が薄いと原因が追えず、コスト上限がないと誤配線に気づきにくく、切り戻し手順がないと「止めるのが怖い」状態になります。

逆に言えば、ここさえ通っていれば、最初は小さな範囲でも十分に前へ進めます。

導入判断は「全部できるか」ではなく、「限定スコープで安全に始められるか」で見たほうが、実装も運用も現実的に進みます。

まとめと次のアクション

本記事の要点3行

Cursor Automationsの本質は、イベントやスケジュールを起点にCloud Agentを走らせ、人が気づく前の一次対応を差し込めることにあります。

そこへMCPを重ねると、SlackやLinearの外側にある情報源や操作まで届くので、自動化の価値が通知から調査補助へ一段広がります。

実際、朝イチに自動レポートが届く小さな成功体験を先につくると、機能説明より先に「これは任せられる」という空気がチームに生まれました。

段階的な導入ロードマップ

最初の一歩は、PRレビュー通知を1本だけ自動化することです。

対象と通知先を絞り、読まれる通知かどうかを見ます。

次に、SlackやLinear起点の調査フローを足して、MCPで外部ツール連携まで広げたときに往復回数が減るかを確かめます。

そこまで手応えが出たら、監査ログ、コスト上限、承認フローを先に定義して、本番運用へ広げる順番が収まりました。

ℹ️ Note

最初から横展開するより、1本で信頼を取り、その後に連携範囲を増やすほうが定着します。

変動しやすいのは、公開時期、価格、使えるトリガーの範囲です。

確認日は2026年3月18日として整理しましたが、導入前には Cursor の Changelog(例: cursor.com/ja/changelog)と公式ドキュメント(Cloud Agents / Automations、Models & Pricing)、および MCP の仕様更新を都度確認し、いま作る運用ルールと食い違いがないかを確かめてください。

変動しやすいのは、公開時期、価格、使えるトリガーの範囲です。

確認日は2026年3月18日として、公開日はCursor Automationsが2026年3月5日、JetBrains対応告知が2026年3月4日という前提で整理しました。

導入前にはCursorの changelog と公式ドキュメント、あわせてMCPの仕様更新を見直し、いま作る運用ルールと食い違いがないかを確認してから進めるのが確実です。

AIビルダーの編集チームです。AI開発ツールの最新情報と使い方を発信しています。

関連記事

MCP自動化パターン10選|導入順と最小手順

MCP自動化パターン10選|導入順と最小手順

筆者の試用では、Jira と Notion を横断して要約する流れを組むと、毎朝の状況把握にかかる時間が短く感じられ、概ね2〜3分程度で済むことがありました。これはあくまで筆者の環境での体験値であり、環境や設定によって大きく変わります。一般化して示す場合は、社内PoCや計測ログなどの出典を併記してください。

Cursor ComposerとAutomationsの違い

Cursor ComposerとAutomationsの違い

Composerは人がCursorのIDE内で対話しながら実装を前に進める高速ループで、Automationsはイベントやスケジュールを起点にクラウドで回り続ける運用ループです。この前提を押さえるだけで、両者を「似たAI機能」とひとまとめにして迷う状態から抜け出せます。

Cursor/Claude Code MCP連携 設定と落とし穴

Cursor/Claude Code MCP連携 設定と落とし穴

CursorとClaude CodeをMCPでつなぐと、エディタ内の操作性とターミナル中心の拡張性を一つの流れで扱えるようになります。この記事は、MCPをこれから実運用に載せたい開発者や、初回設定で止まりたくない人に向けて、CursorをMCPクライアントにする手順、

Cursor Automations 入門と活用例

Cursor Automations 入門と活用例

Cursorを普段の開発で使っていても、Automationsまで触れている人はまだ多くありません。2026年3月5日に公開されたこの機能は、Slack、GitHub、Linear、PagerDuty、Webhook、