AIツール連携ワークフローの作り方

AIツール連携ワークフローの作り方

AIを仕事に入れるとき、いま必要なのはツール名の暗記ではなく、どの工程を誰に任せるかを決める設計です。2024〜2026年の実務では、CursorClaude CodeObsidianNotionを単体で比べるより、入力・処理・出力・保存の4段階に置き直したほうが、

AIを仕事に入れるとき、いま必要なのはツール名の暗記ではなく、どの工程を誰に任せるかを決める設計です。

2024〜2026年の実務では、CursorClaude CodeObsidianNotionを単体で比べるより、入力・処理・出力・保存の4段階に置き直したほうが、導入初日から動く形が見えます。

私自身、朝の仕様整理をObsidianでMarkdownに書き出し、その流れのままCursorで実装に入ると、ノートとエディタを往復する回数が減って思考が途切れにくくなりました。

障害対応ではClaude Codeに調査から修正、テスト、Git反映まで端末内で回してみて、速さそのものより「どこで人が承認するか」を先に決めたワークフローのほうが崩れないと実感しています。

AI連携は複数のツールをつなぐ発想ですが、複雑さを増やせば成果が出るわけではありません。

この記事では、最小構成の3パターンから始めて、段階的な拡張、セキュリティ、ROI判断までを、実務でそのまま置き換えられる形で整理します。

AIツール連携ワークフローとは何か

用語の定義

この文脈でいうAIツール連携ワークフローとは、複数のAIツール、外部システム、人の判断を、ひとつの業務の流れとして接続する設計のことです。

ここでの「ワークフロー」は、単なる自動化の言い換えではなく、誰が何を受け取り、次に何を返すかまで含めて流れを定義するものです。

つまり、本記事では次の3つをほぼ同じ意味で扱います。

AIツール連携は「つなぐこと」、AIオーケストレーションは「役割を割り当てて制御すること」、ワークフローは「その流れを可視化したもの」です。

言い方は違っても、実務で見ている対象は同じです。

たとえばObsidianで要件を書き、Cursorで実装し、Claude Codeでテストと修正を回し、GitHubに反映する流れがあれば、それはすでに連携ワークフローです。

ツール自体の性格もこの整理に当てはめると理解しやすくなります。

Cursorは『Visual Studio Code』系の操作感を持つAIコードエディタとして実装の起点になりやすく、Claude Codeはターミナル上でコード理解、編集、コマンド実行まで扱えるため検証や修正ループの担当に向いています。

Obsidianは標準でAIを持つわけではありませんが、Markdownベースの知識保管庫として前提条件や仕様の置き場所になり、MCPやプラグインで接続先を増やせます。

役者が違う以上、「どれが最強か」ではなく「どこを担当させるか」で見たほうが設計の精度が上がります。

AIオーケストレーションとは | IBM

AIオーケストレーションは、人工知能(AI)モデル、システム、統合の調整と管理を行います。

www.ibm.com単体利用と連携設計の違い

単体利用は、ひとつのAIに長い指示を渡して、その場で答えを引き出す使い方です。

これは立ち上がりが速く、思考の壁打ちや単発の作業には向いています。

ただ、役割分担と受け渡し点が曖昧なまま仕事が進むので、同じ作業をもう一度やると結果がぶれやすく、途中経過も残りにくくなります。

一方の連携設計は、作業を分けて、入力と出力の形式を決めます。

たとえば「仕様はMarkdownで残す」「実装はエディタで行う」「テストはCLIで走らせる」「反映前に人が確認する」という形です。

こうすると、各工程の責任範囲がはっきりし、やり直しも局所化できます。

私自身、LLMに長文プロンプトを一気に投げて仕様からコード、説明文までまとめて出していた時期より、仕様、コード、ドキュメントの受け渡し点を先に決めた後のほうが、出力の揺れが減りました。

特に実装後の説明文や変更理由は、境界を切ったほうが安定します。

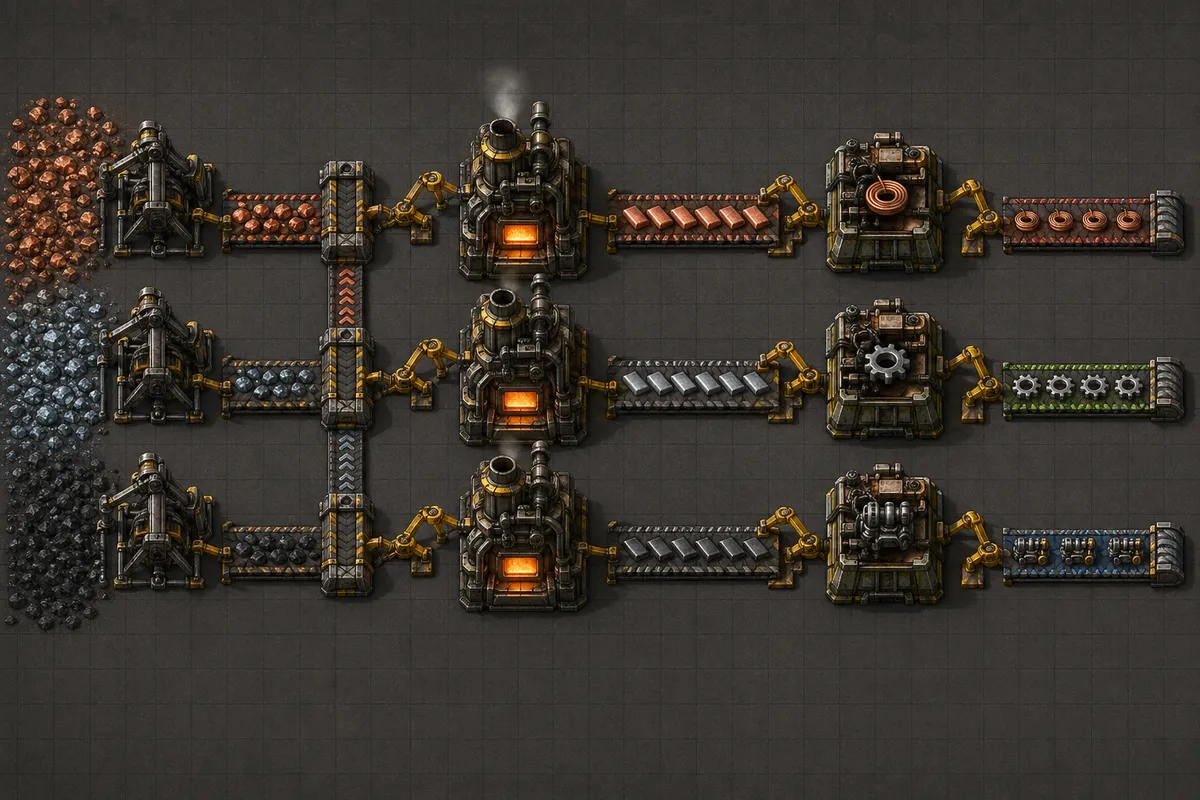

違いを図にすると、イメージは次の通りです。

| 観点 | 単体利用 | ツール連携ワークフロー |

|---|---|---|

| 役割分担 | 1つのAIにまとめて任せる | ツールごとに担当を分ける |

| 引き継ぎ | 会話履歴や人の記憶に依存 | ファイル、Issue、CLI結果などで受け渡す |

| 再現性 | 担当者のプロンプト力に寄りやすい | 手順と入出力が残るので再実行しやすい |

| 向く仕事 | 単発の壁打ち、下書き、要約 | 継続開発、運用、チーム作業 |

ここで効いてくるのが、長大なコンテキストの限界です。

コンテキストウィンドウが広いモデルでも、入力を積み増せば精度が一直線に上がるわけではありません。

だからこそ、全部を一回の会話に押し込むより、工程ごとに必要な情報だけを渡す設計のほうが、現場では扱いやすくなります。

なぜ今必要か

必要性が急に高まった背景には、企業導入の増加と、連携できるツール群の成熟があります。

JUAS調査ベースの数字では、言語系生成AIの導入・準備率は2023年度の26.9%から2024年度の41.2%へ伸びています。

もう「一部の先進企業だけの話」ではなく、どの部署でも何らかの形でAIを業務に入れる前提に近づいています。

成果も抽象論では済まなくなっています。

パナソニック 。

さらに同じくノーコード・ローコード環境によって約半年で100件近いAIエージェントが稼働し、開発者の99%が非エンジニアでした。

ここで見えてくるのは、AI活用のボトルネックが「モデルの性能」だけではなく、「現場が使える流れに落とせるか」に移っていることです。

連携基盤の広がりも追い風です。

Zapierは『公式サイト』で400以上のAIツールと約8,000のアプリ連携を掲げています。

これは、AIを単体で使う段階から、メール、チャット、ドキュメント、CRM、開発環境へつなぐ段階に市場が進んだことを示す数字です。

以前なら個別開発が必要だった連携が、今は設定ベースで成立する場面が増えました。

開発現場でも、道具の役割分化が進んでいます。

Cursorはエディタ起点で実装に入る流れを作りやすく、Claude Codeはターミナルから調査、編集、コマンド実行までつなげられます。

Claude CodeはNode.js 18以上を前提に動くCLIツールとして整理されており、エディタ中心の作業とは別の動線を取り込みやすい構成です。

そこにObsidianやNotionのようなナレッジ基盤を載せると、「考える場所」「書く場所」「直す場所」「残す場所」を分けられます。

今必要なのは、これらを全部使うことではなく、仕事の流れのどこで使うかを定義することです。

Zapier: Automate AI Workflows, Agents, and Apps

zapier.com“必要最小限の複雑さ”の原則

AI連携を考え始めると、マルチエージェントや自律実行の仕組みが魅力的に見えます。

実際、複数エージェントで調査、実装、レビューを分担させる設計は可能です。

ただし、エージェントを増やすほど複雑性、コスト、レイテンシの負担も増えます。

便利な構成ほど、監視点、権限設計、失敗時の切り戻しも増えます。

このトレードオフを踏まえると、実務では必要最小限の複雑さから始めるのが筋が通っています。

最初の一歩としては、ひとつの業務を3段階に切るだけでも十分です。

たとえば、仕様はObsidianまたはNotion、実装はCursor、検証はClaude Codeという分担なら、流れが明快で、どこに問題があるかも追えます。

ここにいきなり自動承認や多段エージェントを重ねるより、人が見るべき箇所を残したほうが運用が安定します。

ℹ️ Note

連携設計で最初に決めるべきなのは、ツール数ではなく受け渡しの単位です。Markdown、Gitの差分、テスト結果、Issueコメントのように、目で確認できる形にそろえると、後から自動化を足しても崩れません。

この原則はコスト面でも自然です。

AI統合やAIエージェント開発には幅のある費用感があり、案件によっては小さくない投資になります。

だからこそ、初期段階では「全部自動化する設計」より、「人が承認する1本の流れを安定させる設計」のほうが費用対効果を測りやすくなります。

前述の通り、AI導入は小さく始める考え方が各所で繰り返し示されていますが、これは慎重論というより、再現可能な仕組みに育てるための順番です。

必要最小限の複雑さという考え方は、保守にも効きます。

Claude CodeのようなCLIツールは更新運用も含めて扱う必要があり、ObsidianはプラグインやMCP構成が増えるほど管理対象も増えます。

構成を増やす前に、どの工程で何が受け渡されるのかが固まっていれば、ツールの入れ替えが起きてもワークフロー自体は残ります。

この記事で扱う連携の基本は、まさにその土台の部分です。

AI エージェント オーケストレーション パターン - Azure Architecture Center

シーケンシャル、コンカレント、グループ チャット、ハンドオフ、マゼンティク パターンなど、AI エージェント アーキテクチャの基本的なオーケストレーション パターンについて説明します。

learn.microsoft.comまず決めるべき4要素:入力・処理・出力・保存

このセクションでは、業務を「入力」「処理」「出力」「保存」の4段階に分けて考えます。

AIツール連携は難しく見えますが、実際に詰まりやすいのは機能不足ではなく、どの情報をどこで受け取り、どこで加工し、どこに残すのかが曖昧な状態です。

先にこの4つを決めておくと、CursorやClaude Codeの役割も自然に決まります。

先に1つだけ押さえておきたいのは、渡し過ぎないという原則です。

コンテキストが長くなるほど品質が落ちる現象は報告されていて、AIに「関係ありそうな資料を全部読む」前提で設計すると、かえって判断がぶれます。

だからこそ、最初から全部を貼り付けるのではなく、必要なノートだけ参照させる設計が効きます。

後でRAGやMCPを入れる場合も、考え方は同じです。

必要部分だけを検索・参照させるための仕組みとして足していきます。

代表的な当てはめ方は次の通りです。

| 段階 | 何を置くか | ツール例 | 受け渡しの最小単位 |

|---|---|---|---|

| 入力 | 要件、メモ、会議ノート、調査メモ | ObsidianNotion | 1つのノート、1ページ |

| 処理 | 実装、調査、修正、テスト、コマンド実行 | CursorClaude Code | 1つのファイル、1つのタスク |

| 出力 | コード、要約、仕様書、PR文面、運用手順 | CursorClaude CodeNotion | 1つの成果物草案 |

| 保存 | 知識の蓄積、履歴管理、再利用 | ObsidianNotionGit | 1ノート、1ページ、1ブランチ |

入力

入力は、AIに何を読ませるかという話である前に、人間が何を正本として持つかの設計です。

ここが曖昧だと、同じ要件がNotionにもObsidianにも散って、実装段階で「どちらが最新なのか」が見えなくなります。

たとえば、会議メモやタスク管理をチームで共有するならNotionは相性が良いです。

ページ共有や権限管理の前提があるので、関係者と同じ画面を見ながら話を進めやすいからです。

一方で、個人の思考整理や下書き、断片メモを積み上げるならObsidianのほうが落ち着く場面があります。

ローカルのMarkdownで持てるので、手元に置いて育てていく感覚があるんですよね。

筆者は、会議体に乗せる前の要件はObsidian、合意後の共有仕様はNotionに置く流れだと、頭の中の整理とチーム共有がぶつかりません。

入力の段階で決めておきたいのは、「AIに渡す単位」です。

要件定義書全文ではなく、今回の実装に関係する1ページだけを渡す。

Vault全体ではなく、対象機能のノート1枚だけを見せる。

この単位を細くしておくと、後工程で迷いません。

Notionを入力に使うなら、ページ単位で切り出せる構成が向いています。

Obsidianを入力に使うなら、1テーマ1ノートで分けておくと参照先がぶれません。

どちらを選ぶにしても、「要件」「制約」「未確定事項」が同じ場所にまとまっている状態が理想です。

処理

位置づけは、CLI 型のClaude Code(Node.js 18+ が必要で、ターミナル中心のワークフローに向く)と、GUI 型のCursor(VS Code 互換の操作感でデスクトップ/ブラウザで利用でき、ファイル一覧・差分・補完を一画面で扱える)で明確に異なります。

どちらを起点にするかで導入手順や権限設計が変わるため、導入前に「操作起点」と「承認点」を決めておくと成功確率が上がります。

参考: Claude Code(導入に Node.js 18+ が必要) / Cursor(VS Code 系の GUI 操作)。

ここでのコツは、処理の役割を1つに寄せることです。

たとえばCursorには「編集中のコードを直す」「その場で小さくリファクタする」を 맡せ、Claude Codeには「テスト失敗の原因調査」「複数ファイルにまたがる修正案の整理」を 맡せる、といった分け方です。

同じタスクを両方に投げると、返ってきた案の比較コストが増えます。

実際に回してみると、Cursorはファイルを見ながら実装を進める場面で流れが切れにくく、Claude CodeはCLIで調査から修正まで一気に走らせたいときに噛み合います。

逆に、仕様の曖昧さを残したまま処理に入ると、どちらのツールでも余計な補完が増えます。

処理の精度は、モデルの賢さだけでなく、入力がどれだけ細く整理されているかに引っ張られます。

この段階でCLAUDE.mdのようなプロジェクト前提を置く運用も有効です。

コーディング規約、テストコマンド、やってはいけない変更範囲が短くまとまっていれば、毎回同じ説明を書き直さずに済みます。

ただし、ここでも情報を盛り込み過ぎると効きが鈍ります。

常時参照してほしい前提だけに絞るほうが、実務では安定します。

出力

出力は「AIが何を作るか」だけでなく、「人が次に扱える形になっているか」で考えると整理できます。

コードが生成されても、どのファイルに入れるのか不明なら次工程に進めません。

要約が返ってきても、意思決定に必要な論点が抜けていれば使い回せません。

この段階の代表例は、コード、要約、ドキュメントです。

CursorやClaude Codeで実装したコードをそのままコミット候補にする。

障害調査の結果を要点3つのメモにまとめる。

PRの説明文や変更概要を草案として出す。

こうした出力物は、あとで保存と接続される前提で作ると扱いやすくなります。

たとえば「ユーザー認証の修正を実施した」という出力よりも、「変更ファイルは auth.ts と session.ts、追加したテストは2件、未対応はトークン失効処理」という形のほうが、次に読む人が迷いません。

出力物は完成度よりも、受け取った人がそのままレビュー、保存、再利用に回せる構造になっていることが効きます。

AIの出力をそのまま最終成果物にするより、人の承認を通すための草案として扱うと安定します。

コードなら差分として、ドキュメントなら追記案として、要約なら論点整理として受け取る。

この位置づけにしておくと、精度のブレがあってもワークフロー全体は崩れません。

保存

保存は、単なる保管ではありません。次回の入力に戻せる形で残す工程です。この観点で見ると、保存先は「読む場所」ではなく「再利用の起点」で決めるとうまくいきます。

コードの履歴はGitに残すのが基本です。

Gitは分散型バージョン管理なので、変更履歴とブランチを軸に作業の流れを保てます。

機能ごとにブランチを切っておけば、「AIにどこまで触らせたか」「どの修正案を採用したか」を差分で追えます。

実装系の成果物をNotionだけに置くと、履歴比較や差分確認が弱くなります。

一方で、判断の背景や運用メモ、失敗した調査ログはObsidianやNotionに残したほうが後で生きます。

コードはGit、仕様の確定版はNotion、個人やチームの知見はObsidianという分け方は、実務でも収まりが良い構成です。

ObsidianはローカルMarkdownなので、あとでまとめて見返すときにも軽く、実装中の気づきを置いておく先として噛み合います。

Notionは共有前提の情報を揃える場所として機能します。

保存でよく起きる問題は、出力物を全部同じ場所に押し込むことです。

コード、設計意図、調査メモ、運用手順を1か所に混ぜると、保存はできても検索と再利用で詰まります。

保存先ごとに役割を固定しておくと、次の入力段階で「どこを見ればいいか」が明確になります。

受け渡し点の設計と最小化

4要素を決めたあとに見直したいのが、工程のあいだの受け渡し点です。

ここでいう受け渡し点は、ノート、ファイル、ブランチ、ページのような「次工程へ渡す実体」です。

ワークフローが散らかる原因は、ツール数そのものより、受け渡し点が多すぎることにあります。

最小構成なら、受け渡し点はこのくらいで十分です。

入力はObsidianまたはNotionの1ノート、処理はCursorまたはClaude Codeの1タスク、出力はコード差分か要約メモ、保存はGitの1ブランチと知識ベースの1ページ。

これ以上の中間成果物を増やすと、どこが正本かを人が追い切れなくなります。

たとえば「要件メモをNotionで作成し、AI向け要約を別ページに切り出し、実装方針をObsidianに写し、コードをCursorで編集し、調査ログをClaude Codeの履歴に残す」という流れは、一見きれいですが受け渡し点が多すぎます。

実際に使ってみると、どこか1か所の更新漏れで全体がずれます。

逆に、「元要件は1ページ、AIに渡すのはその該当見出しだけ、実装結果はブランチに集約、学びだけを1ノートに戻す」という形だと、追跡が一気に楽になります。

MCPやRAGを使う場面でも、この発想は変わりません。

MCPは外部データやツールへ標準化された方法で接続するための仕組みで、RAGは必要な知識だけを検索して生成に渡す考え方です。

どちらも「AIに全部渡す」のではなく、「必要箇所だけを取ってくる」ために入れるものです。

だから、導入前に受け渡し点が整理されていないと、接続先だけ増えて運用が苦しくなります。

ℹ️ Note

受け渡し点は「ファイルなら1つ」「ノートなら1枚」「Gitなら1ブランチ」と数えられる単位まで落とすと、誰が見ても流れを追えます。AI連携はここが細いほど安定します。

最小構成で始める3つの連携パターン

導入パターンは、機能の多さで選ぶより「どこから作業を始めるか」で決めると迷いません。

Cursorを起点にするのか、Claude Codeを起点にするのか、あるいはObsidianNotionのような知識ベースを起点にするのかで、日々の動き方が変わるからです。

実務では3つを全部つなぐ構成も作れますが、初手は1つの起点を決めて、そこに保存先のGitか知識ベースを添えるくらいが収まりのよい始め方です。

まずは全体像を並べると、向き不向きは次のように整理できます。

| 観点 | Cursor中心型 | Claude Code中心型 | ObsidianNotion中心型 |

|---|---|---|---|

| 導入の入りやすさ | ◎ | ○ | ◎ |

| 実装作業との相性 | ◎ | ◎ | △ |

| ターミナル操作との相性 | ○ | ◎ | △ |

| 要件整理・仕様管理 | ○ | ○ | ◎ |

| チームへの説明のしやすさ | ◎ | ○ | ◎ |

| 障害調査・修正ループ | ○ | ◎ | △ |

| 画面上での確認・レビュー | ◎ | ○ | ○ |

| 学習コストの低さ | ◎ | △ | ○ |

| 拡張の伸ばしやすさ(MCP/RAG/Git自動化) | ○ | ◎ | ○ |

Cursor中心型は、VS Code系の画面に慣れている人なら着地が早いです。

コードの差分、ファイル一覧、補完、チャットが同じ視界に入るので、改善提案を受け入れる場面でも判断が早くなります。

対してClaude Code中心型は、調査、修正、テスト、Git操作までターミナル上でつながるため、障害対応を回しているときに画面が散らからない感覚が強く出ます。

ObsidianやNotionを起点にする型は、実装の速さよりも、考える順番と知識の残し方を整えたい人に向いています。

エディタ中心型

Cursorの位置づけは、VS Code系の画面を好むエンジニアにとって導入摩擦が小さい点です。

初期セットアップの要点は次のとおりです: デスクトップまたはブラウザ版をインストール/サインインし、対象リポジトリを開き、既存のショートカットや設定を移行して作業ブランチを切る。

こうした手順を最初に決めると、実務での定着が早まります。

この型が向いているのは、ふだんからGUIでファイルを見ながら考える人です。

コードの修正案、テスト追加、コメント整理、PR草案までを一画面で見比べられるので、「提案を採用するか」を人が決める工程と相性が合います。

実務でも、軽い改善タスクやレビュー前の整形では、この見通しのよさが効きます。

初日セットアップは、詰め込みすぎないほうがうまく回ります。

- Cursorを入れ、対象リポジトリを開く

- 要件や作業メモの置き場をObsidianまたはNotionのどちらか1つに決める

- Gitで作業用ブランチを切る

- AIに渡す単位を「1ファイル」「1関数」「1タスク」に固定する

- 出力はコード差分と短い作業メモだけに絞る

ここから足すなら、拡張は段階的に入れるのが噛み合います。

- 次に足す構成

- ObsidianやNotionの資料を参照元にして、実装前の文脈をエディタ側で読めるようにする

- MCPで外部ドキュメントや社内ツールへの接続を標準化する

- 仕様書や過去メモを検索対象にした軽いRAGを足し、必要箇所だけを取り込む

- GitHubのPRテンプレートやCIに合わせて、説明文やチェック項目を整える

CLI中心型

Claude Code起点の構成は、ターミナルを中心に仕事を組み立てたい人に向きます。

コード編集、コマンド実行、調査、修正、Git操作までを一気通貫でつなげられるのが強みです。

導入条件や基本的な位置づけが整理されています。

前提としてNode.js 18+が必要なので、ここだけ先に整えておくとつまずきません。

この型が合うのは、障害調査、ログ確認、テスト実行、差分確認を何度も往復する場面です。

実際、CLIで回していると、エディタ、ブラウザ、チャット欄を行き来する回数が減り、視線の移動も少なくなります。

特に不具合対応では、調査結果を見てそのまま修正し、テストして、ブランチに積むまでが一本の流れになるので、途中で論点が散りにくい設計です。

コードレビュー前の細かい見た目調整や、提案を比較しながら選ぶ場面では、エディタ中心型のほうが受け入れ判断は進めやすいことがあります。

CLI中心型は「連続した作業の速さ」が光り、GUI中心型は「複数案を見比べる判断のしやすさ」が光る、と捉えると選びやすくなります。

初日セットアップは次の最小構成で十分です。

- Node.js 18+を入れ、Claude Codeを使える状態にする

- 作業対象のリポジトリをローカルに置く

- プロジェクトルートにCLAUDE.mdを置き、よく使うコマンド、テスト手順、触ってよい範囲を書く

- Gitでブランチ運用を始める

- タスクは「調査」「修正」「テスト」の3つに分けて回す

CLAUDE.mdは長文の仕様書にするより、コマンドとルールを短く置くほうが機能します。

プロジェクト前提、実行コマンド、禁止事項、テスト方針だけがまとまっていると、毎回の説明が減ります。

サブディレクトリごとに置ける構成もあるので、フロントエンドとバックエンドでルールが違う案件でも整理しやすいのが利点です。

そこからの拡張は、CLIの強みを伸ばす方向が自然です。

- 次に足す構成

- テスト、Lint、ビルドを定型コマンドとしてCLAUDE.mdに明記する

- Gitのcommit、branch、mergeの流れをAIに扱わせる前提で、ブランチ命名やコミット粒度を決める

- MCPで社内ドキュメント、チケット、ログ基盤などに接続する

- 調査対象が広い案件ではRAGを足し、必要な仕様だけを引く

- GitHubのPRテンプレートやCI結果に合わせて、説明文生成や提出前チェックを自動化する

CLI中心型は、長い会話を持ち続けるより、都度ファイルやコマンド結果に寄せたほうが安定します。

コンテキストが伸びすぎると質が落ちるContext Rotの話がある通り、実務では履歴を延々と抱えるより、調査結果を要約してCLAUDE.mdやメモに戻す運用のほうが崩れません。

Claude Code の概要 - Claude Code Docs

Claude Code は agentic coding ツールで、コードベースを読み取り、ファイルを編集し、コマンドを実行し、開発ツールと統合します。ターミナル、IDE、デスクトップアプリ、ブラウザで利用できます。

code.claude.comナレッジ中心型

ObsidianやNotionを起点にする型は、先に考えを整えてからAIへ渡したい人に向いています。

実装が主目的というより、「要件が曖昧なまま開発に入ると詰まる」タイプの仕事で真価が出ます。

朝にMarkdownで論点を書き出し、その見出し単位でCursorやClaude Codeへ渡すだけでも、AIに与える文脈が締まりやすくなります。

Obsidianの強みはローカルMarkdownベースの軽さで、個人メモや途中の思考を置きやすい点です。

Notionは共有と権限管理に強く、仕様の確定版やチーム向けの整理に向きます。

しかもNotionはメンバーやゲストの権限管理を持ち、API経由でページやデータベースを操作できます。

共有前提の情報と、個人の思考ログを分けたいときは、この2つを役割で切ると収まりが良いです。

この型では、AIツールを主役にしないことがコツです。

主役はノートで、AIは各見出しを処理する補助に回します。

そうすると、要件整理、会議メモ、決定事項、未解決論点が知識ベースに残り、後日見返したときの価値が上がります。

初日セットアップは次の形が軽いです。

- ObsidianまたはNotionのどちらか1つを正本に決める

- 1ページの中を「背景」「やること」「未確定」「AIに渡す本文」に分ける

- AIへ渡す単位を見出し単位に固定する

- 実装が発生する場合だけCursorまたはClaude Codeへ接続する

- 成果物はGitと知識ベースの両方に戻し、コードと判断理由を分けて保存する

この型で足しやすい拡張は、知識の検索性を上げるものです。

- 次に足す構成

- CursorやClaude CodeからVaultやドキュメント群を参照する流れを作る

- MCPで知識ベースとAIの接続を標準化する

- 過去議事録、仕様、運用メモを対象にしたRAGを組み、必要なページだけ検索する

- 確定した仕様をGitHubのIssue、PRテンプレート、タスク記述へ転記する自動化を加える

ナレッジ中心型は情報をため込みやすい反面、接続を増やしすぎると構成が膨らみます。

とくにノート、プラグイン、MCP、RAGを同時に入れると、どこが正本かがぼやけます。

まずは1つのノート基盤を決め、そのあとにAI側から読ませる順で広げるほうが、全体の筋が通ります。

💡 Tip

迷ったら、作業時間の長い場所を起点にすると選びやすくなります。コード編集の時間が長いならCursor、調査と修正の往復が多いならClaude Code、要件整理と知識蓄積の比重が高いならObsidianかNotionが軸になります。

補助:Zapier/ノーコード連携型

Zapierのようなノーコード連携は、3つの起点パターンの代替というより補助線として捉えると噛み合います。

フォーム送信を受けてNotionに記録する、更新をチャットへ通知する、業務アプリのデータを別のツールへ橋渡しするといった役割です。

Zapierは400+のAIツールと約8,000アプリの接続規模を持つため、通知、業務アプリ接続、フォーム起点の自動処理では入り口として扱いやすい存在です。

国内でもノーコードやローコードを土台に非エンジニア主導でAIエージェントが増えており、補助的な連携レイヤーの価値が見えています。

向いているのは、実装そのものより「きっかけを自動で拾う」場面です。

問い合わせフォーム、営業入力、会議終了後の通知、タスク起票、承認依頼など、人が毎回コピペしていた受け渡し点を減らせます。

逆に、複雑なコード修正や深い調査はCursorやClaude Codeの守備範囲です。

この型の最小構成はシンプルです。

- フォーム、メール、チャット通知など、入口を1つ決める

- 出力先をNotionまたはチャットツールのどちらか1つにする

- AI処理は要約や分類など短いタスクに限定する

- 保存先は既存の知識ベースかタスク管理先に寄せる

次に足すなら、他の3パターンにつなぐ形が自然です。

- 次に足す構成

- Notionへ記録した内容をCursorやClaude Codeの作業起点にする

- 通知だけでなく、Issue起票やPR説明文の下書き生成まで広げる

- MCPやRAGを組み合わせ、通知先で必要資料を引ける流れにする

- GitHub連携を足し、変更提案からレビュー前の整形まで受け渡す

補助パターンとして見ると、Zapierは「AIの主戦場」ではなく「仕事を流し込む入口」です。

この位置づけにすると、エディタ中心型、CLI中心型、ナレッジ中心型のどれを選んでも、外側の接続役として無理なく差し込めます。

実践例1:Cursor × Obsidian で仕様から実装までつなぐ

準備

この組み合わせは、Obsidianを仕様の起点にして、Cursorを実装の起点にする、と役割を切ると収まりがよいです。

まずObsidianでVaultを1つ作り、案件ごとのノート置き場を決めます。

ここで最初に効くのが、要件テンプレートを固定することです。

私は「背景」「完了条件」「テスト観点」の3見出しを先に置く形にしてから、AIの提案がぶれにくくなりました。

背景があると実装の意図を外しにくく、完了条件があるとゴールが明確になり、テスト観点があると生成されたコードの抜け漏れを拾いやすくなるからです。

テンプレートは凝りすぎないほうが回ります。

1ノートに背景説明、やること、制約、確認したい点を詰め込みすぎると、読む側も渡される側も焦点を失います。

見出し単位で役割が分かれているだけで、Cursorに渡す文脈が締まります。

ここは長文を書くより、見出しごとに1段落ずつ埋める感覚のほうがうまくいきます。

実装側ではCursorで対象プロジェクトを開きます。

『Visual Studio Code』互換の操作感があるので、普段のショートカットやファイル移動の癖をそのまま持ち込みやすく、エディタ移行の摩擦が少ないのが利点です。

仕様はノートに、コードはリポジトリに、という線引きを最初に作っておくと、どこを更新すべきか迷いません。

Documentation for Visual Studio Code

Your home for multi-agent development. Explore AI agents, coding tools, extensions, and everything you need to build fas

code.visualstudio.com実装フロー

長いノートを丸ごと読ませるより、抜粋と参照先を分けたほうが精度が安定します。

Context Rot(文脈劣化)はコンテキストの上限に届く前でも起こりえます。

だからこそ、仕様から実装につなぐ場面では「全部入れる」より「必要分だけ渡す」ほうが、結果としてコードの修正回数が減ります。

実装中は、Cursorに対して「この要件を満たす最小変更を出す」「関連ファイル候補を挙げる」「テスト観点に沿って確認項目を列挙する」といった依頼の粒度に揃えると進めやすくなります。

仕様の要約、コード変更、テストの観点出しを1回でやらせると、どこでズレたかを追いにくくなります。

ノート側で要件を分解し、エディタ側では一段ずつ進めるほうが、修正の理由も残ります。

レビューに入ったら、指摘をコード側だけで閉じず、Obsidianへ戻します。

ここで戻す対象は全文ではなく、レビューで効いた論点です。

「命名の揺れ」「既存実装との整合」「テストケースの不足」といった再発しやすい観点を、元の要件ノートか別の知見ノートに追記します。

こうしておくと、次の実装では仕様を書く時点で同じ失敗を踏みにくくなります。

知見の戻し方

知見をノートへ戻すときは、完成したコードの説明を書くのではなく、判断の痕跡を残すのが中心です。

たとえば「なぜこの実装を選んだか」「どの条件を切り捨てたか」「レビューでどこを直したか」が残っていると、あとから別の機能を触るときに価値が出ます。

コード自体はGitが履歴を持っていますが、判断理由までは自動で残りません。

分散型バージョン管理であるGitは差分追跡には強い一方で、なぜその変更になったかはコミットやPRだけでは薄くなりがちです。

私がよく使う戻し方は、ノートの末尾に「実装メモ」と「レビュー学び」を短く足す形です。

ここでも長文は要りません。

「完了条件の文言が曖昧で分岐が増えた」「テスト観点に境界値が抜けていた」「既存コンポーネントを流用したほうが差分が小さかった」といった一文が残るだけで、次回の初速が変わります。

要件と実装の往復回数が減るのは、この知見の蓄積が効いてくるからです。

チームで使うなら、確定版だけを共有ノートに移し、途中の思考は個人Vaultに残す運用も噛み合います。

個人の試行錯誤と、チームで参照すべき仕様を混ぜると、どちらも読みにくくなります。

知見の戻し先を「個人の学び」と「共有すべき判断」に分けるだけで、ノートの寿命が延びます。

MCPでの限定参照の設計

ここで出てくるMCPは、Model Context Protocolの略で、LLMアプリケーションが外部データソースやツールに標準化された形で接続するためのオープンプロトコルです。

仕様はmodelcontextprotocol.ioで公開されており、サーバー、ツール、transportといった要素で構成されています。

実務での意味は単純で、AIがローカルの知識ベースや外部ツールに触れるときの受け口を揃えられる、ということです。

この文脈で大事なのは、ObsidianのVault全体を無条件で見せないことです。

推奨したいのは、「必要なノートだけ取る」設計です。

具体的には、実装タスクごとに参照対象を絞り、ノートID、ファイルパス、タグ、更新日などの条件で候補を狭めます。

そのうえで、取得する本文も全文ではなく、見出し単位か要約単位に切るほうが扱いやすいのが利点です。

MCPは接続手段であって、文脈を増やす免罪符ではありません。

この考え方は、RAGの設計と近いです。

Google CloudやAWSのRAG解説でも、外部知識を検索して必要な断片だけを生成に渡す流れが基本になっています。

Vault参照でも発想は同じで、「要件ノートの全文を常時読む」のではなく、「今のファイル変更に関係するノートの該当見出しだけ取る」ほうが、実装支援としては筋が通ります。

個別のMCPサーバー設定や接続手順は別テーマですが、設計思想としては限定参照を前提にしたほうが破綻しません。

ℹ️ Note

Vault参照は「検索対象の全件公開」ではなく、「ノートの所在を教え、必要な断片だけ取りに行く」くらいの距離感だと、仕様と実装のあいだが締まります。

つまずきと対策

最初にぶつかりやすいのは、ノートの肥大化です。

1つのノートに会議メモ、要件、実装メモ、レビュー結果を積み上げていくと、あとから見返したときにどこが現行仕様なのか判別しづらくなります。

対策は単純で、命名規則を決めて分けます。

たとえば「feature-auth-login」「decision-error-handling」「review-form-validation」のように役割をファイル名へ入れるだけでも、一覧で迷いません。

さらに日付IDを先頭や末尾に足しておくと、時系列も追いやすくなります。

次に起きやすいのが、版管理の不整合です。

ここでは、変更履歴の運用ルールを決めておくのが効きます。

要件ノートに更新日と変更理由を1行残し、コード側ではコミットやPR本文に対応するノート名を入れるだけで、仕様と差分の往復が追えます。

GitHubはPRテンプレートを公式にサポートしているので、テンプレートに「対応ノート」「完了条件」「テスト観点」を置く設計とも相性がよいです。

もう1つはリンク切れです。

Vault内のリネームや階層変更でリンクが死ぬと、AI参照でも人間の閲覧でも手間が増えます。

これも運用で抑えられます。

ファイル名の接頭辞、日付ID、役割名を固定し、確定済みノートをむやみに移動しないだけで、リンクの寿命は伸びます。

知識ベースは自由さが魅力ですが、実装と接続した瞬間に「好きに書ける場所」から「作業基盤」に変わります。

自由記述の気楽さを残しつつ、参照されるノートだけは構造を守る。

その境界を引けると、ObsidianとCursorの連携は日常の流れに定着します。

実践例2:Claude Code × Git × ドキュメントで調査・修正・検証を回す

準備

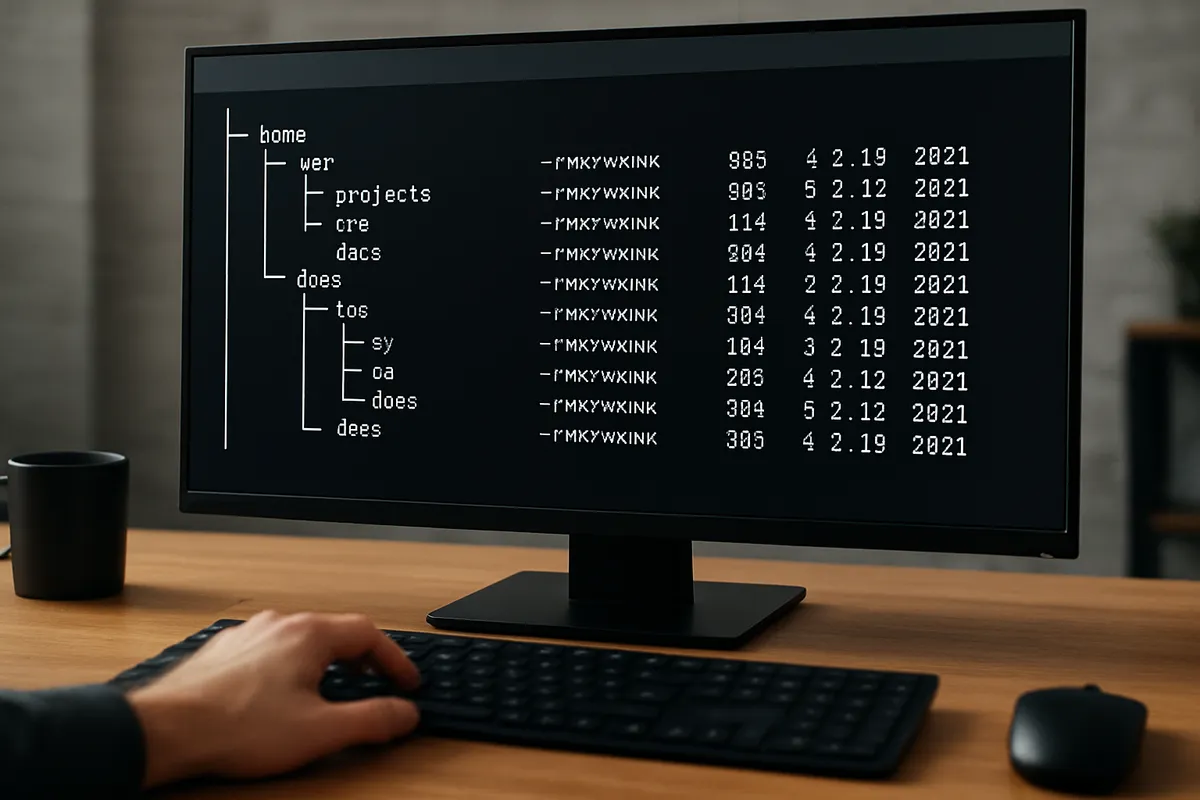

導入前提としては Node.js 18 以降が必要で、CLI ベースでファイルの読み書きやテスト実行、Git 操作をターミナルから一貫して行える点が特徴です。

インストール後はローカルにリポジトリを置き、小さなブランチで試運用し、どの操作を自動化するか承認点を定義してからスケールしてください。

インストールや更新は、ローカルのパッケージ管理に合わせて明示的に回しておくと詰まりません。

macOS でHomebrewを使うなら、たとえば brew upgrade で関連パッケージを上げる流れになりますし、Windows でWinGetを使うなら winget upgrade で対象を更新する運用になります。

CLIツールは「入れた時点の版がそのまま残る」ことが多いので、初回導入だけで終わらせず、更新コマンドを手元の運用に入れておくと会話と挙動のズレを減らせます。

初回実行で意識したいのは、権限承認の扱いです。

Claude Codeはファイルの読み書き、テスト実行、Git操作のように、開発作業の実体に触れます。

そのため、最初の数回は「どの操作が自動で進み、どこで承認が入るか」を観察したほうが流れをつかみやすいのが利点です。

いきなり大きなリポジトリ全体を触らせるより、修正範囲が見えているブランチで始めると、CLI型AIエージェントの強みがわかりやすく出ます。

調査→修正→検証→Git反映

CLI型AIエージェントの良さは、コードを読んで説明するところで止まらず、そのまま修正、テスト、Git反映まで同じ場所で回せる点です。

たとえば、既存のNode.jsアプリでテストが落ちている場面なら、まず失敗しているテスト名と関連ファイルを読ませて、「落ちている理由をコードベースから説明して」と依頼します。

ここで答えをそのまま採用するのではなく、まず原因説明だけを出させるのが最初の承認判断材料になります。

見立てが合っていれば、次に「最小差分で直す」「既存の設計を崩さない」「影響範囲のあるテストだけ先に回す」と条件を足して編集させます。

修正後は対象テストを実行し、通ったら関連スイートを広げる、という順で進めると差分と失敗理由が追えます。

私は実際に、テストが赤くなったケースで「なぜ失敗したか」をClaude Codeに説明させてから、条件分岐の扱いだけを最小限に直し、再テストを通したうえでPR文面まで作らせたことがあります。

この流れだと、原因調査と手修正を行き来する時間が減ります。

人間が見るべきなのは、説明が妥当か、差分が余計に広がっていないか、テスト範囲が不足していないかの3点に絞られます。

Git反映も同じターミナル内で続けられます。

流れとしては、作業用ブランチを切り、変更差分を確認し、コミットし、必要ならPR作成までつなげます。

Gitは分散型バージョン管理なので、ローカルで履歴を刻みながら進められますし、ブランチを分ける前提とも噛み合います。

ここでの承認ポイントは少なくとも3つあります。

修正前の原因認識、修正後の差分確認、そしてコミットまたはPR送信の直前です。

AIに全部を一気に走らせるより、この区切りを置いたほうが、CLIの速さを保ちながら事故を抑えられます。

チーム運用まで含めるなら、PR本文に「何を直したか」だけでなく、「なぜその修正にしたか」「どのテストで担保したか」を残す形が相性良好です。

差分が可視化され、レビューの論点も揃います。

GitHubはPRテンプレートを公式にサポートしているので、テンプレート側に確認項目を持たせておくと、AIが作るPR文面にも一定の型を与えられます。

Claude Code の仕組み - Claude Code Docs

agentic ループ、組み込みツール、Claude Code がプロジェクトとどのように相互作用するかを理解します。

code.claude.comCLAUDE.mdでルールを共有

この一連の流れを安定させるのが CLAUDE.md です。

これはClaude Codeが参照する、プロジェクト固有の前提をまとめるためのマークダウンファイルで、公式ドキュメントでも運用前提として扱われています。

役割は単純で、「このリポジトリでは何が正しいのか」を会話のたびに説明し直さなくて済むようにすることです。

ここに書いておくと効くのは、コーディングスタイル、ディレクトリ構成、依存関係の要点、よく使うテストコマンド、禁止事項、レビューで重視する観点です。

たとえば「フロントエンドは npm test ではなく個別パッケージのスクリプトを使う」「API層では例外を握りつぶさない」「UI文言は既存辞書から取る」といったルールがあるなら、CLAUDE.md に短く固定しておく価値があります。

毎回プロンプトに含めるより、参照精度が安定します。

ファイルは長文化させすぎないほうが機能します。

細則を全部書き込むより、「このプロジェクトの判断軸」を先に置いたほうが、修正提案の質が揃います。

ルートに共通ルールを置き、領域ごとにサブディレクトリ側の CLAUDE.md で補足する構成も扱いやすいのが利点です。

バックエンドとフロントエンドでテストコマンドや禁止パターンが違うリポジトリでは、この分け方だけで解像度が上がります。

チームで使うときは、会話ログや調査メモの保存先も合わせて決めておくと再利用率が上がります。

バグ調査の経緯をGitHub Issueに残すのか、設計判断をNotionや社内Docsに戻すのか、境界が曖昧だと次回また同じ説明から始まります。CLAUDE.md は単なる説明書ではなく、「AIに何を読ませ、何を正式記録にするか」の入口でもあります。

承認フローの設計

Claude Codeをチームに入れるときは、能力より先に承認フローを設計したほうが運用が安定します。

CLI型AIエージェントは、読んで提案するだけの補助役ではなく、編集と実行まで手を伸ばせるからです。

その分、どこを自動化し、どこを人が止めるかを曖昧にすると、便利さがそのまま不安材料になります。

現場で回しやすいのは、調査、軽微な修正、テスト実行、PR草案作成まではAIに任せ、人間は承認点だけを見る形です。

たとえば、ブランチ作成は自動、コード変更は差分確認後に承認、コミットはメッセージを見て承認、PR作成は本文確認後に送信、と段階を分けます。

この分割だと、作業時間を削りながら責任の所在もぼやけません。

レビュー観点をリスト化しておくのも効きます。

項目は多くなくてよく、既存スタイルに沿っているか、影響範囲のテストが回っているか、ロールバックしやすい差分か、のような観点で足ります。

PRテンプレートにこの観点を入れておけば、AIが作成した説明文にも枠ができます。

差分の可視化、PRテンプレ、レビュー観点の固定は、チームで再現性を持たせるための最小セットです。

ℹ️ Note

迷ったら、作業時間の長い場所を起点にすると選びやすくなります。コード編集の時間が長いならCursor、調査と修正の往復が多いならClaude Code、要件整理と知識蓄積の比重が高いならObsidianかNotionが軸になります。 承認フローは「AIを信用するかどうか」ではなく、「どの操作を記録付きで通すか」を決める設計として置くと、議論がぶれません。

よくあるつまずき

最初に起きやすいのは、AIへの依頼が広すぎて差分まで広がることです。

「落ちているテストを全部直して」のような投げ方だと、関連の薄い箇所まで触り始めます。

ここでは、失敗テスト名、対象ファイル、修正の制約を先に固定したほうが、最小差分に収まりやすくなります。

CLI型AIエージェントは一気通貫で速いぶん、最初の指示が広いとそのまま広範囲に進みます。

次に詰まりやすいのが、CLAUDE.md を置いたのに中身が抽象的すぎるケースです。

「品質を保つ」「読みやすいコードにする」だけでは、実際の修正方針に落ちません。

既存命名規則、テスト実行コマンド、避ける実装、依存関係の前提まで書いておくと、提案のぶれが減ります。

逆に細かな背景説明を長文で積みすぎると、必要情報が埋もれます。

もうひとつは、会話と成果物の保存先が散ることです。

ターミナル上のやり取りだけで解決してしまうと、その場では速くても、次に同じ障害が出たときにチーム資産になりません。

どの調査ログをIssueに残すか、どの判断をDocsへ戻すかを決めておくと、AIとの往復が一回限りの作業で終わらなくなります。

CLI型AIエージェントの強みはスピードだけではなく、調査から修正、検証、Git反映までを記録可能な作業としてつなげられる点にあります。

MCP・RAG・ルールファイルはどこで使うべきか

用語の整理

このあたりの話は、名前だけ先に広まって中身が混線しやすいところです。

まず切り分けると、MCP は外部ツール接続の共通規格、RAG は知識参照を強化する仕組み、ルールファイルはプロジェクト固有の指針です。

似た文脈で語られますが、担当している役割は別です。

Model Context Protocolは、LLM アプリケーションが外部データやツールに標準化された方法でアクセスするための仕様として公開されています。

Anthropic発の仕様ですが、考え方としては「AIが外の世界に触るための共通インターフェース」に近いです。

ファイル参照、チケット確認、テスト実行、社内ツールへの接続のように、モデル単体の会話では完結しない処理を、一定の形でつなぐのが役目です。

仕様の全体像はModel Context Protocolの公式仕様で確認できます。

一方の RAG は、モデルにそのまま全部覚えさせるのではなく、手元や社内の知識を検索して、その結果を踏まえて回答させる考え方です。

Google Cloud のRetrieval-Augmented 。

ここで扱う対象は、会議メモ、仕様書、議事録、FAQ、設計ドキュメントのような「知識」です。

つまり RAG は、外部ツールを操作するためのものではなく、答えの根拠になる材料を引いてくるための仕組みです。

ルールファイルはもっと地に足のついた存在で、CLAUDE.md や開発規約、命名規則、PR テンプレートのように、そのプロジェクトで何を正解とみなすかを固定するためのものです。

前述の CLAUDE.md がまさにそれで、AI に毎回説明しなくて済む前提条件を短く置いておく役割があります。

MCP が「外に手を伸ばす方法」、RAG が「知識を引く方法」だとすると、ルールファイルは「この現場での判断軸」を決める土台です。

導入順の考え方

現場で安定しやすい順番は、ルールファイルから始めて、その次に MCP、必要になったら RAG です。順番を逆にすると、仕組みだけ増えて判断がぶれます。

初手で効くのは、CLAUDE.md や開発規約の整備です。

理由は単純で、どの AI ツールを使っても、最終的に困るのは「このプロジェクトで何を守るべきか」が曖昧な状態だからです。

たとえばGitHubの PR テンプレートと CLAUDE.md の内容が揃っていれば、修正提案、コミット文、PR 草案まで一貫した型に寄せられます。

これは外部連携より先に効く改善です。

次に置くのが MCP です。

AI に外部ツールを触らせたい場面、たとえばテスト実行、Issue 参照、社内 API 呼び出し、ドキュメント取得が増えてきたら、接続方法を個別実装で増やすより、共通規格に寄せたほうが運用が崩れません。

とくに CLI 中心のフローでは、読むだけでなく実行や取得までつながるため、MCP のような「安全な境界越えアクセス」の考え方が効いてきます。

RAG はその後です。

知識量が増え、会話に毎回貼り込むのが現実的でなくなってから導入するくらいがちょうどいいです。

コンテキストウィンドウが広いモデルでも、長文を丸ごと渡せば安定するわけではありません。

Context Rot の話ともつながりますが、入力が長くなるほど、関係の薄い情報や古い文脈が混ざって回答の軸がぶれます。

実際、私も会議録や仕様書を全文そのまま食べさせる運用を試したことがありますが、回答に余計な文脈が混ざりやすく、論点が散りました。

見出しとその前後数段落だけを抽出して渡す形に変えると、答えの一貫性が目に見えて揃いました。

RAG は「たくさん読ませる仕組み」ではなく、「必要な断片だけを持ってくる仕組み」と捉えたほうが実務に合います。

ユースケース別の適用例

ナレッジ中心の仕事では、RAG の効きどころがはっきりしています。

たとえばObsidianやNotionに会議メモ、要求整理、仕様変更履歴がたまっているチームなら、AI に全部読ませるより、「今回の機能に関係する見出しだけを拾い、その周辺だけを抜く」構成のほうが精度が上がります。

会議メモから仕様要点だけを抽出したい場面では、決定事項、未決事項、制約条件の見出し単位で切り出して渡すほうが、要約も設計補助も安定します。

ここでルールファイルに「仕様要約は決定事項と未決事項を分ける」「引用元の見出し名を残す」といった指針を足すと、知識参照と出力形式がつながります。

CLI 中心の仕事では、MCP が前面に出ます。

Claude Codeのようにターミナルを起点に作業する場合、テスト実行、Git 操作、チケット参照、ログ取得を一つの流れで扱いたくなります。

たとえば、不具合対応で Issue の内容を見て、対象ブランチを切り、失敗テストを走らせ、差分を作って PR 草案までつなぐ流れでは、AI が外部ツールへ届く経路を揃えておく価値が高いです。

このとき RAG は補助役で、過去の障害メモや設計判断を引くほうに回し、実行系は MCP に任せると整理しやすくなります。

ドキュメント管理が主軸の現場でも、役割分担を分けると設計が軽くなります。

Notionは API でページやデータベースを扱えるので、社内ナレッジの参照元として向いています。

ただし、AI に直接すべてを探索させるより、まずルールファイルで「どのデータベースを正本とするか」「古いメモは除外するか」を固定し、そのうえで必要なページだけ取得する流れのほうが迷走しません。

ツール接続と知識検索を一度に盛り込むより、何を正式記録として扱うかを先に決めたほうが、後から構成が増えても破綻しにくくなります。

過剰構築を避ける判断基準

MCP も RAG も名前が立派なので、入れた瞬間に仕事が整理されるように見えますが、実際には人手で十分なものまで自動化しないという線引きが欠かせません。

更新頻度が低いルール、月に数回しか見ない資料、担当者がすぐに探せる既知の場所にある情報なら、検索基盤や接続基盤を組むより手作業のほうが軽い場面は普通にあります。

判断軸としては、メンテコスト、セキュリティ、レイテンシの三つを見るとぶれにくい設計です。

メンテコストでは、接続先の API 変更、インデックス更新、ルールファイルの保守まで含めて回るかを見ます。

RAG は一度作ると終わりではなく、どの文書を取り込み、どう分割し、古い情報をどう捨てるかまで面倒を見る必要があります。

MCP も同様で、接続先が増えるほど権限管理と障害切り分けが増えます。

セキュリティの軸では、「AI がその情報や操作に触れてよいか」を先に切ります。

たとえば社内チケット閲覧は許可しても、本番変更や顧客データ抽出は別扱いにする、という境界が必要です。

これは仕組みの立派さではなく、どこまでを自動化対象に含めるかの設計です。

レイテンシも見逃せません。

検索、要約、引用、外部 API 呼び出しを積み重ねると、1 回の応答に待ち時間が乗ります。

短いやり取りで済むタスクに重い RAG パイプラインを入れると、得られる精度差より待ち時間のほうが気になります。

知識を毎回引く必要がない定型作業なら、CLAUDE.md のルールだけで足りることも多いです。

⚠️ Warning

迷ったときは、「その仕組みがなくなると毎回同じ説明を人が繰り返すか」「その仕組みが壊れたとき誰が直すか」を並べると、導入の優先度が明確になります。

導入の派手さより、どの層の問題を解いているかを揃えるほうが、結果として長く持ちます。

ルールファイルで判断軸を固定し、MCP で必要な外部操作だけをつなぎ、RAG は本当に知識検索がボトルネックになった時点で足す。

この順番なら、仕組みが増えても現場の流れは重くなりません。

導入時の落とし穴:セキュリティ・コスト・コンテキスト肥大化

データと権限の基本方針

導入直後にいちばん事故になりやすいのは、モデルの精度不足よりも、何を渡してよくて、どこまで触れてよいかが曖昧なまま運用が始まることです。

ここは最初に線を引いておく必要があります。

実務では、データを少なくとも「公開」「社内」「機密」「特機密」の4段階で分け、AI に投入してよい範囲を分類しておくと判断がぶれません。

たとえば公開情報は製品サイトや公開ドキュメント、社内は一般的な議事録や社内手順、機密は顧客名を含む案件資料、特機密は個人情報、生データ、本番資格情報、未公開の財務・契約情報といった整理です。

この区分を作るときに欠かせないのが、持ち出し禁止データを先に言語化することです。

API キー、アクセストークン、秘密鍵、顧客の生データ、未公開契約書、個人情報を含む CSV は、便利さより先に除外対象として定義したほうが混乱を防げます。

NotionやGitHubの権限機能を使えば、閲覧範囲そのものを絞れますが、ツール上で見えることと、AI に渡してよいことは同義ではありません。

閲覧権限があるメンバーでも、AI ワークフローには要約済みの断片だけを渡す設計のほうが安全です。

権限は「まとめて管理者」で始めると後から戻せなくなります。

Claude Codeのように CLI からファイル編集やコマンド実行に踏み込む系統は、『Claude Code の仕組み』を見てもわかる通り、作業の幅が広いぶん承認境界の設計が欠かせません。

リポジトリ閲覧、テスト実行、ドキュメント参照、Issue 読み取りまでは許すが、本番環境の変更や顧客データ抽出は分ける、といった最小権限の原則で切ると、事故の範囲を局所化できます。

AI に「何でもできる」状態を与えるより、「このタスクではここまで」と絞ったほうが、出力も行動も安定します。

コストとパフォーマンスの初期判断

一部の報道ベースの報告では、大きなコンテキストウィンドウをベータ提供しているモデルの事例が取り上げられています(報道例: Anthropic 系の報道)。

ただし、これらは一次ソース(ベンダーの公式発表)での確認が必要です。

常時大きな窓を前提にせず、どの処理で広いコンテキストが本当に必要かを見極めて使い分けてください。

相場感としても、単純な AI 統合は数千ドル台から十数万ドル超、エージェント開発は数万ドル台から数十万ドル超で語られることが多く、設計範囲が広がるほど費用差が大きくなります。

ここで効いてくるのは、派手な自動化を最初から狙わないことです。

前のセクションでも触れた通り、単体利用から始めて、次にツール連携ワークフローへ進む順番なら、費用の増え方を追いやすくなります。

最初からマルチエージェント前提にすると、開発費だけでなく、評価・監視・権限分離の運用費まで一緒に立ち上がります。

💡 Tip

コスト見積もりは「モデル利用料」だけでなく、「連携1回あたりの課金」「検索や保存の基盤費」「保守の人件費」を同じ表に並べると、何が固定費で何が従量費か見えます。

コンテキスト肥大化の対策

導入初期は、資料を多く渡すほど賢くなると思いがちです。

私も最初はその発想で、会議メモ、仕様書、関連 Issue、過去の修正履歴を一気に貼る運用をしていました。

ところが実際には、同じ質問でも答えの軸が毎回ずれました。

古い議論を拾ってきたり、補足欄の一文を主論点のように扱ったりして、出力が安定しませんでした。

そこで資料の渡し方を見直し、見出しの粒度を揃えて「決定事項」「未決事項」「制約」「対象外」の単位で切り出すように変えたところ、回答のぶれが目に見えて減りました。

内容量より、どの単位で整理されているかのほうが効きます。

ここで問題になるのが Context Rot、つまり長文コンテキストの劣化です。

Chroma 。

長い入力の中には、いま必要な情報だけでなく、寄り道や古い前提やノイズも混ざります。

AI はその全部を同じ場に置かれると、どれを重く見るべきかで迷います。

だから対策の基本は、渡し過ぎないことです。

実務では、全文投入よりも四つの型を回したほうが安定します。

ひとつは要点抽出で、長文から決定事項と制約だけを先に抜く方法です。

次が分割参照で、ドキュメントを章や見出し単位に区切って、その都度必要部分だけ渡す流れです。

さらに、RAG を使う場合も「関連度の高い断片だけを返す」設計に寄せると、文脈の濁りが減ります。

仕上げとして、検証プロンプトをパターン化しておくと効きます。

たとえば「根拠に使った見出し名を併記する」「決定事項と推測を分ける」「回答前に前提の矛盾を列挙する」といった形式を固定すると、長文の中で論点が滑りにくくなります。

CLAUDE.mdのようなルールファイルも、ここでは長文化させるより、判断軸を短く置くほうが向いています。

プロジェクトの目的、参照優先順位、禁止事項、出力形式を簡潔にまとめ、都度のタスクでは必要な断片だけ足す。

文脈を一つの巨大ファイルに押し込むより、永続ルールとタスク固有情報を分けたほうが、応答の軸が保たれます。

更新・依存の運用注意

見落とされやすいのが、ツールは入れた瞬間に完成しないという点です。

AI 連携ワークフローは、モデル本体だけでなく、CLI、拡張機能、Node.js、MCP サーバー、外部 API に依存します。

たとえばClaude Codeは Node.js 18 以上を前提にしており、CLI 系の道具なので、エディタ拡張のような自動更新感覚で放置すると前提がずれていきます。

新機能の記事だけ読んで「そのうち入るだろう」と考えていると、実際には手元の環境だけ古いまま、という状態が起きます。

とくに注意したいのは、自動更新を前提にしないことです。

Claude Codeの CLI は手動アップグレードが必要になる場面があり、ローカル環境の更新漏れがそのまま挙動差になります。

チーム内で「ある人は使えるのに、ある人は同じコマンドで動かない」という状況は、権限やモデル差ではなく、単純に CLI や依存ランタイムの版差で起きます。

こうなるとプロンプト改善では解決できません。

依存先が増えるほど、障害の切り分けも難しくなります。

MCP でつないだ外部ツールが応答しないのか、トークン権限が足りないのか、RAG 側の索引が古いのか、モデル出力が揺れているのかを見分ける必要が出ます。

GitHubの PR テンプレートや Issue テンプレートを使って、「利用モデル」「CLI の版」「失敗したコマンド」「接続先」を記録するだけでも、再現の速度が変わります。

AI 導入の失敗は、派手な誤答より、こうした地味な依存管理のほころびから始まることが多いです。

効果測定の始め方:小さく始めてROIを可視化する

導入の成否は、最初に何を自動化したかより、導入前後を同じ物差しで比べられるかで決まります。

AI ツールは手応えだけで評価すると、速くなった気がする作業と、実際に工数が減った作業が混ざります。

継続改善につなげるには、まず比較の土台を作り、その上で 1 週間だけ小さく回し、続けるか広げるかを判断する流れがいちばん安定します。

ここでいう“小さく始める”は、前の章で見た 3 パターンのうち 1 つだけを選び、対象業務も 1 種類に絞ることです。

たとえばCursorで実装補助だけ試す、Claude Codeで調査と修正の往復だけ試す、ObsidianやNotionで仕様整理からプロンプト化だけ試す、といった切り方です。

最小構成で 1 週間回すと、良かった点だけでなく、どこで止まったかも観察できます。

ベースラインの取り方

最初にやるべきことは、導入前 1 週間の作業記録を残すことです。

ここで揃えるべきなのは、記録の細かさです。

レビュー作業は「PR 1 件ごと」、問い合わせ対応は「1 チケットごと」、記事作成は「1 本ごと」のように、比較単位を固定します。

同じチームでも、ある人は 30 分単位、ある人は半日単位で記録すると、あとで差分を見ても判断がぶれます。

最低限そろえたいのは、作業時間、件数、再作業の発生、応答時間です。

開発系の仕事なら、PR レビューにかかった時間、レビュー対象件数、差し戻し後の再確認回数、バグの再発率を見ます。

ドキュメント作業なら、初稿作成時間、修正回数、レビュー指摘の密度、テンプレート再利用数を置くと流れが見えます。

ポイントは、AI 導入後だけ細かく測らないことです。

導入前が粗く、導入後だけ詳細だと、改善したように見えても比較として成立しません。

私がレビュー運用を見直したときも、まず PR レビューを 5 件だけ並べて、見ている項目をそろえました。

時間だけでなく、コメントの往復回数や、同じ指摘が何度出たかまで書き出すと、表面の処理速度とは別の差が見えます。

CLAUDE.mdを整備した後は、レビュー観点がそろったことでコメントの往復が減り、レビューの途中で前提確認に戻る場面が少なくなりました。

ここは数分単位の短縮だけで語るより、手戻りの質が変わったと捉えたほうが実態に近いです。

KPIセット例

KPI は多ければいいわけではありません。

導入初期は、時間削減・品質改善・再利用率・応答時間の 4 系統に絞ると、改善の方向が読み取りやすくなります。

時間削減は「分/件」で置くのが基本です。

たとえば PR 1 件、記事 1 本、問い合わせ 1 件といった単位です。

総時間だけだと件数の増減に引っ張られるため、1 件あたりに直したほうが比較しやすくなります。

品質改善では、再作業率とレビュー指摘密度が効きます。

再作業率は、いったん完了したものが差し戻しや修正で戻った割合です。

レビュー指摘密度は、PR や文書レビューでどれだけ指摘が出たかを、件数やページ数、変更量とセットで見ます。

指摘数そのものより、同じ種類の指摘が減っているかを見ると、ルールファイルやテンプレートの効き方が見えます。

再利用率は見落とされがちですが、導入を継続運用に変える指標です。

テンプレートやプロンプトを毎回書き直しているうちは、その人の工夫で回っているだけで、仕組みになっていません。

GitHubの PR テンプレートや Issue テンプレートを使っているなら、何件で再利用されたかを見るだけでも、運用が属人化していないか判断できます。

ルールをCLAUDE.mdやドキュメントに寄せたなら、参照回数よりも、同じ型で再実行できた件数のほうが役に立ちます。

応答時間は、モデルが返答する速さだけではなく、作業が止まる待ち時間として測るのが実務向きです。

たとえば「指示を出してから修正案が出るまで」「レビュー依頼から一次返信まで」といった形です。

ここは生成時間だけを見ると、ツール切り替えや確認待ちが抜け落ちます。

測定の最小セットは次の形で足ります。

| KPI分類 | 指標 | 単位 | 見るポイント |

|---|---|---|---|

| 時間削減 | 作業時間/件 | 分/件 | 導入前後で 1 件あたりの所要時間がどう変わったか |

| 品質改善 | 再作業率 | % | 差し戻しや修正戻りが減っているか |

| 品質改善 | レビュー指摘密度 | 件/PR、件/ページ | 同じ指摘の繰り返しが減っているか |

| 再利用率 | テンプレート再利用数 | 件 | 個人の工夫ではなく運用として回っているか |

| 再利用率 | プロンプト再利用数 | 件 | 定型化された入力が増えているか |

| 応答時間 | 初回応答までの時間 | 分 | 待ち時間が作業の詰まりになっていないか |

1週間/1か月の測定テンプレ

1 週間の測定では、まず 1 日ごとのばらつきを見ます。

1 か月の測定では、再利用が定着したか、品質面の反動が出ていないかを見ます。

短期では速度改善が出ても、月単位で見るとレビュー負荷が増えている、ということは珍しくありません。

1 週間のテンプレートは、最小構成なら次の形で十分です。

| 日付 | 対象業務 | 件数 | 総作業時間(分) | 作業時間/件(分/件) | 再作業件数 | レビュー指摘件数 | テンプレ/プロンプト再利用数 | 初回応答までの時間(分) | メモ |

|---|---|---|---|---|---|---|---|---|---|

| 1日目 | PRレビュー | ||||||||

| 2日目 | PRレビュー | ||||||||

| 3日目 | PRレビュー | ||||||||

| 4日目 | PRレビュー | ||||||||

| 5日目 | PRレビュー |

1 か月では、週次合計に加えて、失敗要因の棚卸し欄を持たせると判断しやすくなります。

止まり方の傾向は 1 週間でも見えますが、月単位で見ると「たまたま忙しかった日」と「設計が悪くて毎回詰まる場所」が分かれます。

| 期間 | 対象業務 | 総件数 | 平均作業時間/件(分/件) | 再作業率 | レビュー指摘密度 | テンプレ再利用数 | プロンプト再利用数 | 平均初回応答時間(分) | 主な失敗要因 |

|---|---|---|---|---|---|---|---|---|---|

| 1週目 | PRレビュー | ||||||||

| 2週目 | PRレビュー | ||||||||

| 3週目 | PRレビュー | ||||||||

| 4週目 | PRレビュー |

失敗要因の棚卸しは、抽象語で終わらせないほうが次の改善につながります。

たとえば「プロンプトが悪い」ではなく、前提不足、参照資料の粒度不一致、レビュー観点の未定義、承認待ちの滞留、テンプレート未整備、といった形に分けます。

原因を工程に落とすと、次週にどこを触るべきかが見えます。

💡 Tip

1 週間の試行では、対象業務を 1 種類に固定し、比較する前週も同じ単位で記録すると、改善なのか案件差なのかを切り分けやすくなります。

簡易ROIの計算と意思決定

導入初期の ROI は、厳密な会計よりも、続ける価値があるかを判断するための簡易式で十分です。

基本は (効果 − コスト) ÷ コスト です。

ここでの効果には、時間削減だけでなく、品質改善によって減った再作業や、テンプレート再利用で浮いた準備時間も入れます。

コストには、ツール利用料だけでなく、設定に使った時間、テンプレート整備時間、運用ルールの更新時間を含めます。

実務では、時間削減だけで ROI を出すと見誤ります。

たとえば 1 件あたりの作業時間が少し減っても、レビュー指摘が増えて再作業が戻ってきているなら、月単位では得をしていません。

逆に、処理速度そのものは大きく変わらなくても、コメント往復が減り、テンプレート再利用が増えているなら、次月以降の改善余地があります。

だから意思決定では、ROI を 1 本の数字として見るより、時間・品質・再利用率の 3 本柱で並べて判断するほうがぶれません。

簡易試算の型は次のように置けます。

| 項目 | 内容 |

|---|---|

| 効果 | 時間削減分の価値 + 再作業削減分の価値 + テンプレ/プロンプト再利用で浮いた時間の価値 |

| コスト | ツール利用料 + 初期設定時間の価値 + ルール整備時間の価値 |

| ROI | (効果 − コスト) ÷ コスト |

この式を 1 週間で一度出し、1 か月で再計算すると、初期コストの重さと再利用の効き方が分かります。

1 週間では赤字でも、テンプレートやCLAUDE.mdが整い、レビュー往復が減っていくなら、月次で改善する余地があります。

逆に、時間短縮が出ていても、再作業率が上がり続けるなら、その運用は広げないほうがいいと判断できます。

意思決定をシンプルにするなら、1 週間の時点では「継続」「縮小して再試行」「停止」の 3 択で十分です。

継続は、時間削減か品質改善のどちらかが見えていて、再利用率も上向いている状態です。

縮小して再試行は、効果はあるが対象業務が広すぎた、ルールが粗い、といったときです。

停止は、待ち時間や手戻りが増え、ベースラインより悪化しているときです。

ここまでを小さく回せると、導入は単発の盛り上がりで終わらず、次に何を整えるべきかが数字で見えるようになります。

まとめと次のアクション

要点の再確認

AIツール連携は、まず業務を入力・処理・出力・保存の4段階で分けるところから始まります。

次に、Cursor中心型、Claude Code中心型、ObsidianやNotion中心型の3パターンから、いちばん近い最小構成を1つ選びます。

導入順は、先にルールを置き、その後でMCP、必要が見えてからRAGへ進める流れが崩れにくい設計です。

そのうえで、機密情報の扱いと、導入前後でどれだけ時間が変わったかを早い段階で見ておくと、広げる判断がぶれません。

私自身も、最初の1週間だけは意識して最小構成を崩さずに回しました。

そこで余計な連携を足さなかったぶん、「次に増やすなら何が必要か」と「まだ増やさなくていいもの」が自然に分かれ、拡張時の失敗が減りました。

チェックリスト

次にやることは多くありません。順番だけ守れば、試行の質が上がります。

- 今の業務を入力・処理・出力・保存の4つに書き出す

- 3パターンのうち最も近い構成を1つ選び、1週間だけ試す

- 機密情報の取り扱いルールを先に決め、導入前後の時間を記録する

💡 Tip

迷ったら、機能の多さではなく「今週の仕事を1つ流し切れるか」で選ぶと判断がぶれません。

さらに学ぶ

- Cursor 使い方入門(社内リンク候補:)

AIビルダーの編集チームです。AI開発ツールの最新情報と使い方を発信しています。

関連記事

MCP自動化パターン10選|導入順と最小手順

MCP自動化パターン10選|導入順と最小手順

筆者の試用では、Jira と Notion を横断して要約する流れを組むと、毎朝の状況把握にかかる時間が短く感じられ、概ね2〜3分程度で済むことがありました。これはあくまで筆者の環境での体験値であり、環境や設定によって大きく変わります。一般化して示す場合は、社内PoCや計測ログなどの出典を併記してください。

Cursor ComposerとAutomationsの違い

Cursor ComposerとAutomationsの違い

Composerは人がCursorのIDE内で対話しながら実装を前に進める高速ループで、Automationsはイベントやスケジュールを起点にクラウドで回り続ける運用ループです。この前提を押さえるだけで、両者を「似たAI機能」とひとまとめにして迷う状態から抜け出せます。

Cursor Automationsの始め方と運用設計

Cursor Automationsの始め方と運用設計

Cursor Automationsは、SlackやGitHubなどのイベント、あるいはスケジュールを起点にCloud Agentsを自動実行する機能です。

Cursor/Claude Code MCP連携 設定と落とし穴

Cursor/Claude Code MCP連携 設定と落とし穴

CursorとClaude CodeをMCPでつなぐと、エディタ内の操作性とターミナル中心の拡張性を一つの流れで扱えるようになります。この記事は、MCPをこれから実運用に載せたい開発者や、初回設定で止まりたくない人に向けて、CursorをMCPクライアントにする手順、